Zajmuję się montażem wideo od dawna, ale projektowanie dźwięku zawsze było dla mnie najtrudniejsze. Potrafię godzinami szukać odpowiedniego efektu dźwiękowego – czy to będzie dramatyczny szum, trzask w kominku, czy delikatny dźwięk w tle – i wciąż nie mogę znaleźć takiego, który by pasował. Większość bibliotek dźwięków jest przesadnie droga, zbyt podstawowa albo po prostu nieodpowiednia.

W zeszłym tygodniu pracowałem nad krótkim filmem podróżniczym. Oprawa wizualna była gotowa – kolory, cięcia i przejścia wyglądały dobrze – ale kiedy go obejrzałem, wydał mi się płaski. Brakowało mu klimatu. Wtedy mnie olśniło: nie potrzebowałem tylko dźwięku w tle, potrzebowałem dźwięku, który wspierałby historię.

Zacząłem więc szukać generatora dźwięku opartego na sztucznej inteligencji, który byłby w stanie zrozumieć, o co proszę, zamiast dawać mi losowe efekty dźwiękowe.

Oto, czego chciałem:

Po przetestowaniu kilku narzędzi zdałem sobie sprawę, że większość tak zwanych platform „AI” po prostu wykorzystuje biblioteki dźwięków stockowych. Ale jedno narzędzie wyróżniało się – generowało dźwięk z samego komunikatu. Kiedy wszedłem do „starych metalowych drzwi powoli otwierających się w ciemnym korytarzu”, wygenerowało dźwięk, który brzmiał realistycznie, szczegółowo i idealnie pasował do mojej sceny.

Po raz pierwszy nie musiałem się męczyć z dopasowaniem dźwięku do mojego filmu – mogłem kształtować dźwięk zgodnie z moją historią.

Teraz zamiast spędzać godziny na przeszukiwaniu bibliotek dźwięków, po prostu opisuję dźwięk, którego potrzebuję – na przykład „delikatny dźwięk deszczu uderzającego o szkło wieczorem” – a sztuczna inteligencja tworzy go w ciągu kilku sekund.

Postanowiłem wybrać najlepsze dla siebie narzędzia i podzielić się nimi w tym artykule. W tym celu poprosiłem o pomoc moich kolegów z zespołu FixThePhoto. Wybraliśmy kilka projektów – niektóre z mojej pracy zawodowej, a niektóre z filmów lifestylowych do mediów społecznościowych, nakręconych przez moich współpracowników.

Spisaliśmy, czego potrzebuje każdy projekt i zaczęliśmy testować różne generatory dźwięku. Przejrzeliśmy fora, przyjrzeliśmy się rekomendacjom, a następnie zaczęliśmy testować każde narzędzie.

Świetny dźwięk w filmach nie zaczyna się na komputerze. Zaczyna się w Twojej głowie. Po pierwsze, poznaj emocje swojej historii Każda scena ma inny klimat, na przykład spokojny, energiczny lub tajemniczy. Kiedy wiesz, jakie uczucie chcesz osiągnąć, możesz zaprojektować dźwięk, aby je stworzyć, zamiast dodawać go na samym końcu.

Tworzenie dźwięku do filmów jest teraz prostsze dzięki sztucznej inteligencji. Nie musisz już przeszukiwać niezliczonych bibliotek dźwięków. Wystarczy… opisz emocje, scenę lub atmosferę, którą próbujesz stworzyć, a sztuczna inteligencja stworzy dźwięk za Ciebie. Precyzyjny opis przyniesie najlepsze rezultaty.

Ta sama zasada dotyczy głosów. Wybierz głos który pasuje do stylu Twojego filmu: mocny, czysty głos do samouczka; miękki, powolny głos do smutnej historii; lub energiczny głos do dynamicznego klipu. Dzięki sztucznej inteligencji te głosy brzmią teraz naturalnie i realistycznie, idealnie pasując do Twojego filmu.

Po dodaniu narracji i efektów dźwiękowych, prawdziwa praca zaczyna się podczas montażu. Regulacja głośności, tempa i dopasowania dźwięków do obrazu sprawia, że wszystko wydaje się naturalne i żywe. Nawet małe szczegóły - delikatny szum tła, delikatne echo lub drobne zmiany korektora dźwięku mogą sprawić, że dźwięk będzie sprawiał wrażenie, że naprawdę pasuje do sceny.

Ostatecznie, uzyskanie świetnego dźwięku nie zależy wyłącznie od narzędzi, których używasz. Chodzi o to, aby poznać nastrój i przesłanie swojego filmu Kiedy zrozumiesz historię i emocje, które chcesz przekazać, sztuczna inteligencja po prostu pomoże Ci je wyrazić. Projektowanie dźwięku przestaje być problemem technicznym, a staje się płynnym elementem procesu opowiadania historii.

| Co robić | Czego nie robić |

|---|---|

|

✔️ Zanim zaczniesz tworzyć dźwięk, zdecyduj, jaki nastrój i klimat będzie miał Twój film.

|

❌ Nie zaczynaj generować dźwięku, nie wiedząc, jaką atmosferę chcesz uzyskać.

|

|

✔️ Napisz szczegółowe wskazówki z czytelnymi opisami.

|

❌ Nie stosuj krótkich i niejasnych komunikatów, takich jak „muzyka w tle” lub „głos”.

|

|

✔️ Wybierz styl głosu i tempo pasujące do obrazu i przekazu.

|

❌ Nie używaj tego samego tonu głosu w każdym projekcie.

|

|

✔️ Dostosuj czas, głośność i mieszanie podczas edycji dźwięku.

|

❌ Nie dodawaj dźwięków bez synchronizacji z filmem.

|

|

✔️ Dodaj delikatne dźwięki otoczenia, aby scena wydawała się realistyczna.

|

❌ Nie pozostawiaj dźwięku pustego lub zbyt czystego.

|

|

✔️ Wykorzystaj sztuczną inteligencję jako narzędzie wspierające Twoją kreatywność.

|

❌ Nie oczekuj, że sztuczna inteligencja wykona za Ciebie całą pracę twórczą

|

Kiedy po raz pierwszy otworzyłem Wideo Adobe Firefly, nie byłem pewien, czego się spodziewać. Wiele o nim słyszałem, ale nigdy tak naprawdę nie zgłębiłem jego możliwości – zwłaszcza że zazwyczaj ręcznie szukałem dźwięków i narracji w bibliotekach stockowych.

Postanowiłem wypróbować to w projekcie, który był dla mnie trudny: dramatycznej scenie człowieka spacerującego po pustym mieście o zachodzie słońca. Zwykle spędziłbym dużo czasu, przeszukując biblioteki dźwięków w poszukiwaniu kroków, wiatru i delikatnego miejskiego klimatu – a nawet wtedy prawdopodobnie skończyłbym z czymś, co nie do końca mi odpowiadało.

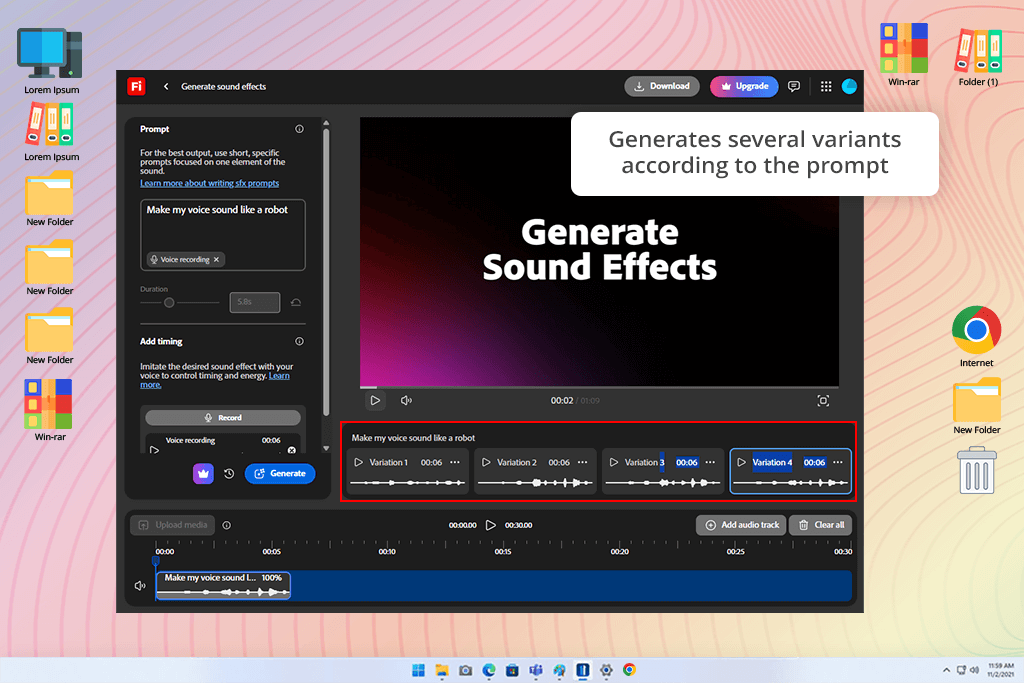

Wprowadziłem do tego generatora efektów dźwiękowych szczegółowy komunikat: „Echo kroków na cichej miejskiej ulicy o zachodzie słońca, delikatny wiatr, ciche syreny w oddali, kinowy nastrój”. W ciągu zaledwie kilku sekund wygenerowano wiele wersji dźwiękowych. Jakość mnie zaskoczyła – kroki miały realistyczne tempo i siłę, wiatr tworzył atmosferę, nie zagłuszając niczego, a odległe syreny dodawały subtelnego napięcia. Rezultat był bogaty i wielowarstwowy, a nie jak jeden krótki dźwięk powtarzany overi_w kółko.

Następnie sprawdziłem, jak bardzo mogę dostosować dźwięk. Udało mi się zmienić siłę wiatru w tym darmowe oprogramowanie Adobe, dodać lub zmniejszyć echo, aby kroki wydawały się bliższe lub dalsze, a nawet oddzielić różne części miksu audio.

Umieściłem dźwięk stworzony przez Firefly bezpośrednio na osi czasu mojego filmu. Idealnie pasował do wizualizacji, a scena od razu wydała się bardziej realistyczna. Interfejs ułatwił mi wypróbowywanie różnych wersji – mogłem generować, słuchać, dostosowywać i zamieniać dźwięki bez opuszczania obszaru roboczego.

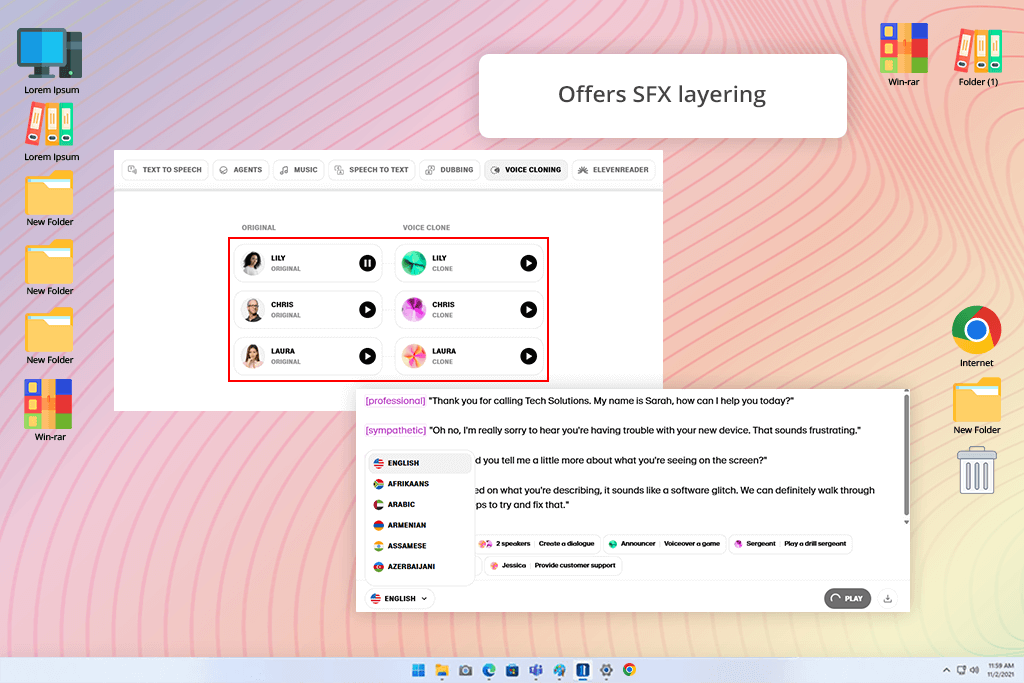

Przetestowałem ElevenLabs na scenie, która wymagała narracji do krótkiego filmu dokumentalnego. Napisałem krótką sugestię opisującą pożądany ton: spokojny, wyraźny i stabilny. W ciągu zaledwie kilku sekund ElevenLabs wygenerował narrację, która brzmiała bardzo naturalnie – rytm, akcent, a nawet krótkie oddechy wydawały się realistyczne.

Najbardziej zaimponowała mi łatwość, z jaką mogłem dostosować szczegóły głosu. Mogłem zmieniać tempo, ton i akcent bez użycia skomplikowanego darmowego oprogramowania do edycji dźwięku z którego korzystałem wcześniej. W przypadku efektów dźwiękowych próbowałem dodawać takie rzeczy jak wiatr i lekki deszcz.

Chociaż ElevenLabs został zaprojektowany głównie z myślą o głosach, dźwięki otoczenia, które wygenerował, idealnie pasowały do mojego filmu. Ogólnie rzecz biorąc, ElevenLabs to doskonały wybór, jeśli Twój projekt opiera się głównie na narracji, z możliwością dodania efektów tła w razie potrzeby.

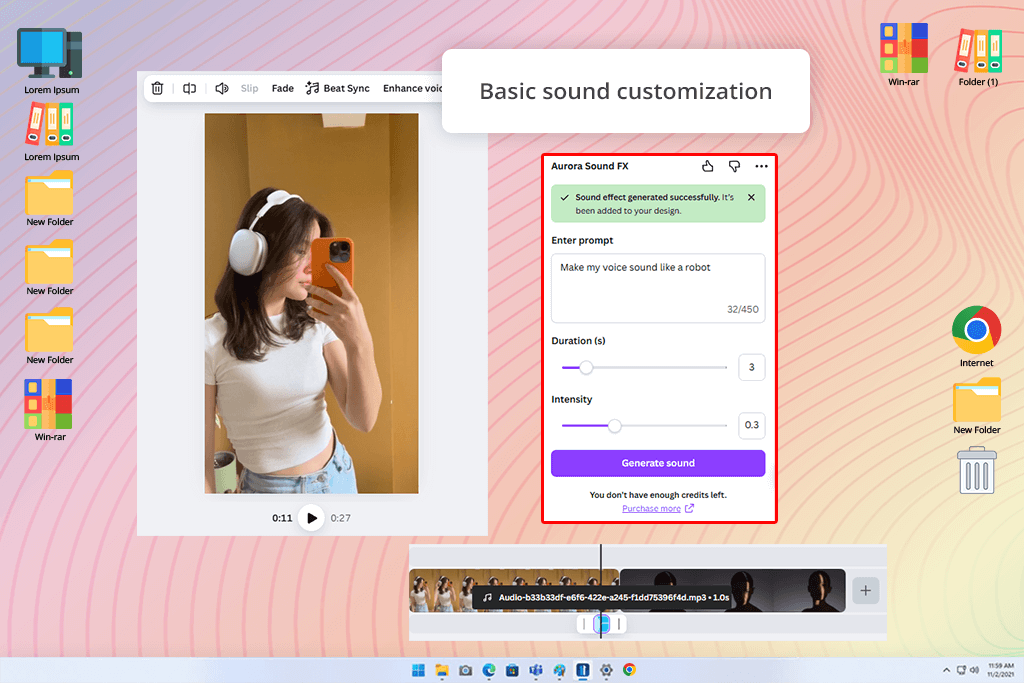

Nie sądziłem, że canva będzie mocną aplikacją do tworzenia dźwięku, ale jej funkcje audio oparte na sztucznej inteligencji okazały się bardzo łatwe w obsłudze. Wgrałem krótki klip promocyjny i potrzebowałem delikatnego tła – delikatnego wiatru i delikatnych dźwięków dzwonka, aby dopasować się do optymistycznego nastroju.

canva pozwolił mi wprowadzić krótki opis i szybko wygenerował kilka opcji dźwiękowych, których podgląd mogłem wyświetlić i umieścić bezpośrednio na osi czasu.

Główną zaletą jest to, jak proste i spójne wydaje się to wszystko. Nie potrzebujesz żadnych umiejętności w zakresie dźwięku – sztuczna inteligencja oferuje kilka gotowych opcji dźwiękowych, które możesz umieścić bezpośrednio w swoim projekcie Canva. Nie jest ona przeznaczona do szczegółowej edycji dźwięku, ale do szybkiej i wygodnej pracy, w której chcesz, aby dźwięk natychmiast pasował do obrazu, co idealnie sprawdza się w materiałach marketingowych i filmach do mediów społecznościowych.

Najlepsze jest to, że możesz zrobić wszystko w jednym edytorze. Bez eksportowania, przełączania się między aplikacjami i korzystania z osobnych Generatory muzyki AI. To niezwykle przydatne przy tworzeniu szybkich treści społecznościowych.

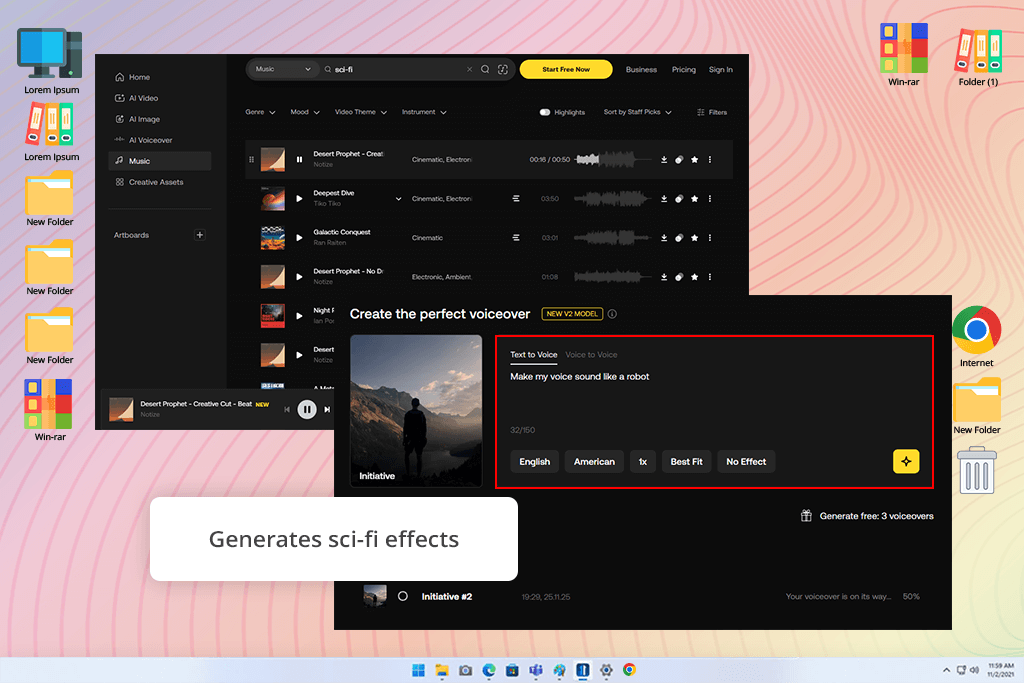

Silnik SFX przypominał korzystanie z profesjonalnego generatora efektów dźwiękowych. Wypróbowałem go, tworząc wielowarstwowe dźwięki science fiction – strzały laserowe, uderzenia metalu i ciche buczenie statku kosmicznego. Narzędzie pozwoliło mi zmieniać takie rzeczy, jak wysokość dźwięku, echo i jego położenie w przestrzeni, dając mi poziom kontroli, który normalnie znajduję tylko w pełnym darmowe DAW-y.

Najbardziej uderzające było to, jak autentyczne były dźwięki. Wiele narzędzi AI generuje powtarzalne lub płaskie efekty, ale SFX Engine stworzył dźwięk, który brzmiał bogato i kinowo, niczym ścieżka dźwiękowa z profesjonalnego filmu.

Silnik SFX nie jest najlepszym generatorem głosu opartym na sztucznej inteligencji (AI) do tworzenia szybkich klipów do mediów społecznościowych. Jest on przeznaczony dla twórców, takich jak filmowcy, animatorzy i twórcy gier, którzy oczekują pełnej kontroli i realistycznego dźwięku. Wadą jest to, że nauka obsługi zajmuje dużo czasu i wymaga wydajnego komputera. Jeśli jednak zależy Ci na dźwięku o profesjonalnej jakości, to jedno z najlepszych dostępnych narzędzi.

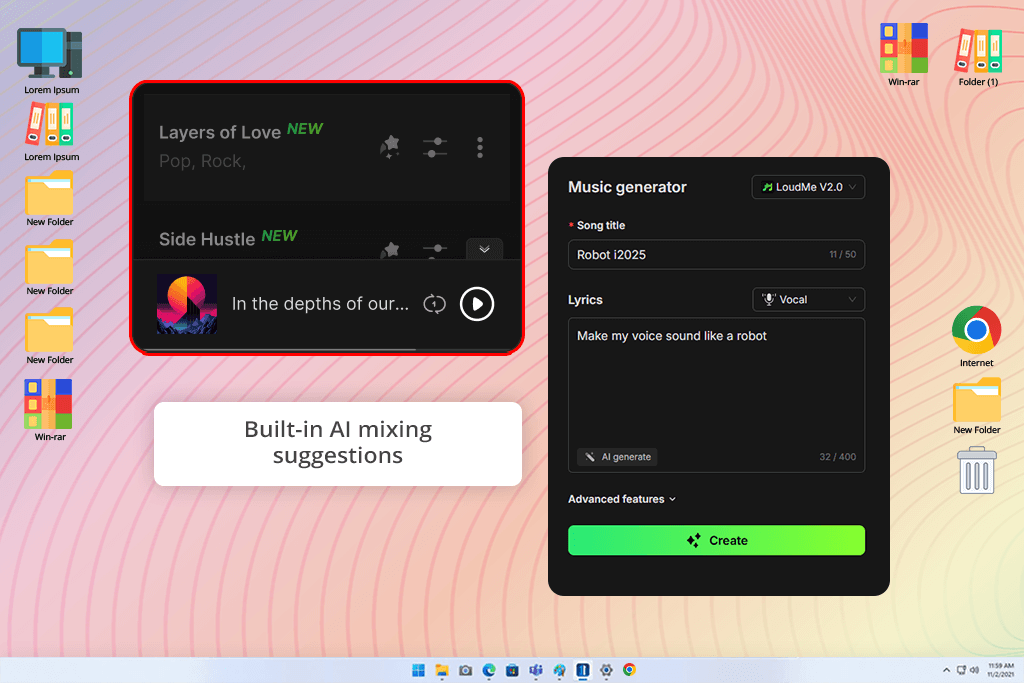

Korzystanie z LoudMe sprawiało wrażenie, jakbym miał pomocnika, który już rozumie atmosferę, którą chcę stworzyć. Montowałem kawiarnię vlog i chciałem, żeby dźwięk w tle brzmiał realistycznie, ale nie odwracał uwagi – ciche rozmowy, odgłosy ekspresów do kawy, dźwięki świateł w talerzach.

Wpisałam opis otoczenia i po kilku sekundach LoudMe zaproponowało mi kilka wersji do wyboru. Każda z nich charakteryzowała się innym poziomem szumu tła i tonem. Wybrałam tę, która brzmiała najbardziej naturalnie i umieściłam ją w edycji – pasowała idealnie bez żadnych dodatkowych korekt.

Najlepsze było to, że to oprogramowanie głosowe automatycznie sugerowało odpowiedni balans głośności na podstawie dźwięku w moim filmie. Nie musiałem ręcznie regulować dźwięku tła i mowy.

To nie jest najbardziej zaawansowana opcja do szczegółowej edycji dźwięku, ale świetnie nadaje się do szybkich, realistycznych rezultatów. Dla vlogerów, twórców i wszystkich, którzy pracują szybko, LoudMe zapewnia czyste, naturalne środowisko, praktycznie bez dodatkowego wysiłku.

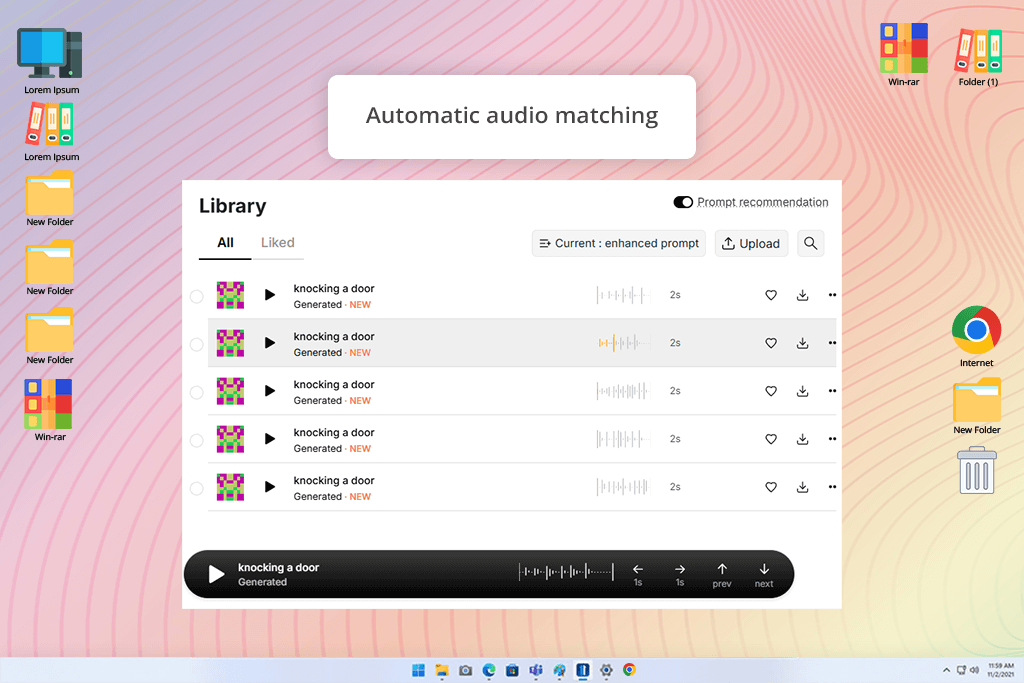

OptimizerAI zwrócił moją uwagę, ponieważ twierdzi, że tworzy dźwięk automatycznie dopasowany do obrazu. Chciałem sprawdzić, czy rzeczywiście potrafi analizować wideo i generować dźwięk dopasowany do sceny. Widziałem też na forach, że ludzie piszą, że dobrze działa z Twórczość animowane głosy, więc chciałem to również przetestować.

Wgrałem krótką scenę bitwy z jednego z moich projektów – szybkie ujęcia, uderzenia mieczem i ciężkie kroki. OptimizerAI automatycznie odczytał tempo i ruch w filmie. Następnie, po wpisaniu krótkiego komunikatu, takiego jak „intensywna atmosfera średniowiecznej bitwy”, od razu stworzył efekty dźwiękowe, które pasowały do akcji.

Najbardziej zaskoczyło mnie to, jak sztuczna inteligencja sama synchronizowała dźwięki z akcją – kroki pasowały do ruchu, uderzenia huśtawek trafiały idealnie w huśtawki, a echo w tle zmieniało się naturalnie. Nie musiałem niczego regulować.

KlingAI został stworzony dla twórców, którzy chcą dźwięku, który jest pomysłowy i nierealny. Wypróbowałem ten generator głosu AI over w onirycznej animacji i potrzebowałem dźwięku, który byłby miękki i płynny. Napisałem krótką sugestię: „delikatne dzwonki z głębokimi, brzęczącymi tonami i powolnymi, falowymi pulsami”.

Kilka sekund później KlingAI wygenerował dźwięki, które brzmiały niemal jak żywe. Nie brzmiały jak typowe efekty, które można znaleźć na typowych stronach z utworami wolnymi od opłat licencyjnych. Zamiast tego miały głębię i atmosferę. Połączyłem kilka wygenerowanych klipów, a efekt końcowy wydawał się oryginalny – czego nie mogłem uzyskać ze standardowej biblioteki dźwięków.

KlingAI nie został zaprojektowany z myślą o naturalnych ani dosłownych środowiskach audio – koncentruje się na ekspresyjnym, nastrojowym brzmieniu. Najlepiej sprawdza się w artystycznych wstępach, przejściach nastroju lub filmach eksperymentalnych, gdzie zależy Ci na czymś emocjonalnym i wyrazistym.

Wadą jest to, że rezultaty mogą się różnić i może być konieczna kilkukrotna regeneracja, aby uzyskać dokładnie takie wrażenie, jakiego oczekujesz. Ale kiedy efekt końcowy się zgadza, daje to coś naprawdę wyjątkowego.

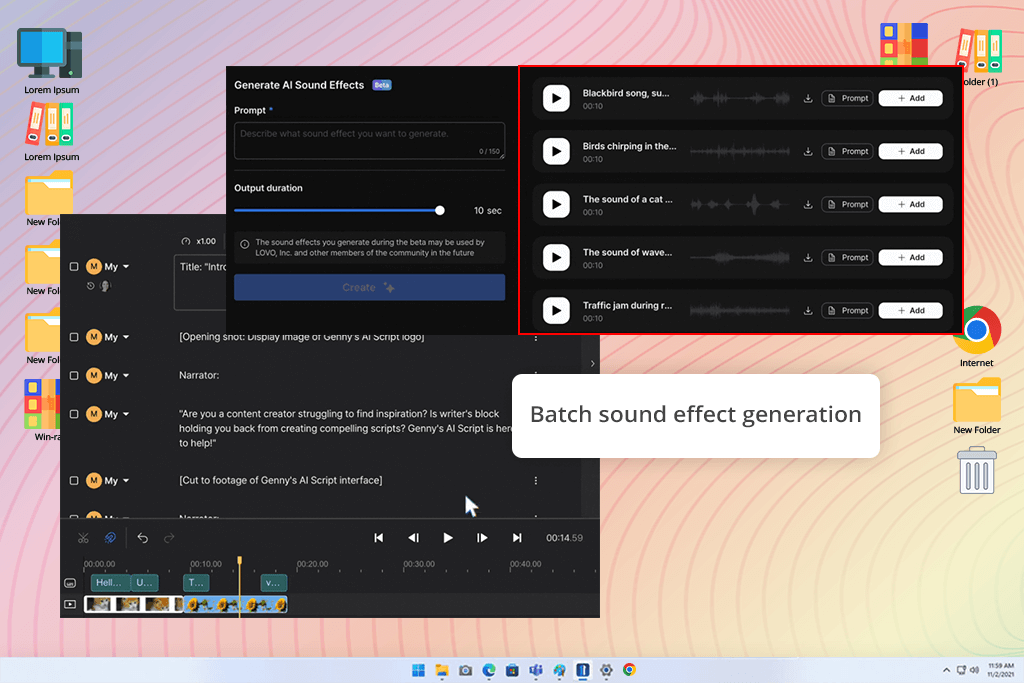

Wypróbowałem Genny'ego, pracując nad projektem animacji 2D, który składał się z kilku krótkich scen. Potrzebowałem różnych dźwięków, takich jak kroki, otwieranie drzwi, śmiech i odgłosy miasta w tle, ale nie miałem czasu, aby stworzyć każdy dźwięk osobno.

Funkcja wsadowa Genny'ego naprawdę mnie zaskoczyła. Wprowadziłem kilka poleceń jednocześnie i wygenerowało to wiele efektów dźwiękowych w jednym przejściu. Wszystkie dźwięki dobrze do siebie pasowały i były już zrównoważone i czyste, co jest rzadkością w przypadku korzystania z oprogramowania sztucznej inteligencji bez dodatkowej edycji.

Został zaprojektowany tak, aby działać szybko i płynnie. Przełączanie między różnymi wersjami dźwiękowymi zajmowało mi niemal błyskawiczne chwile, więc mogłem testować opcje bez przerywania procesu edycji.

Genny nie jest przeznaczony do głębokiej, szczegółowej edycji dźwięku, ale idealnie nadaje się dla animatorów, YouTuberów i twórców małych projektów, którzy potrzebują dużej ilości wysokiej jakości dźwięku w kilka minut. Jest łatwy w użyciu, niezawodny i oszczędza mnóstwo czasu.

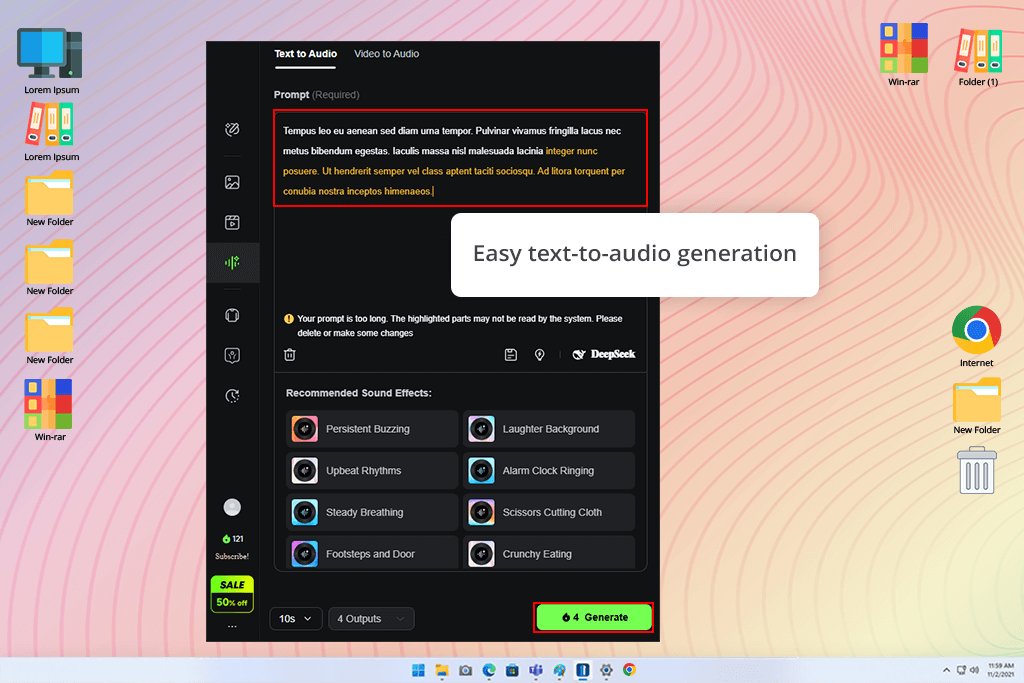

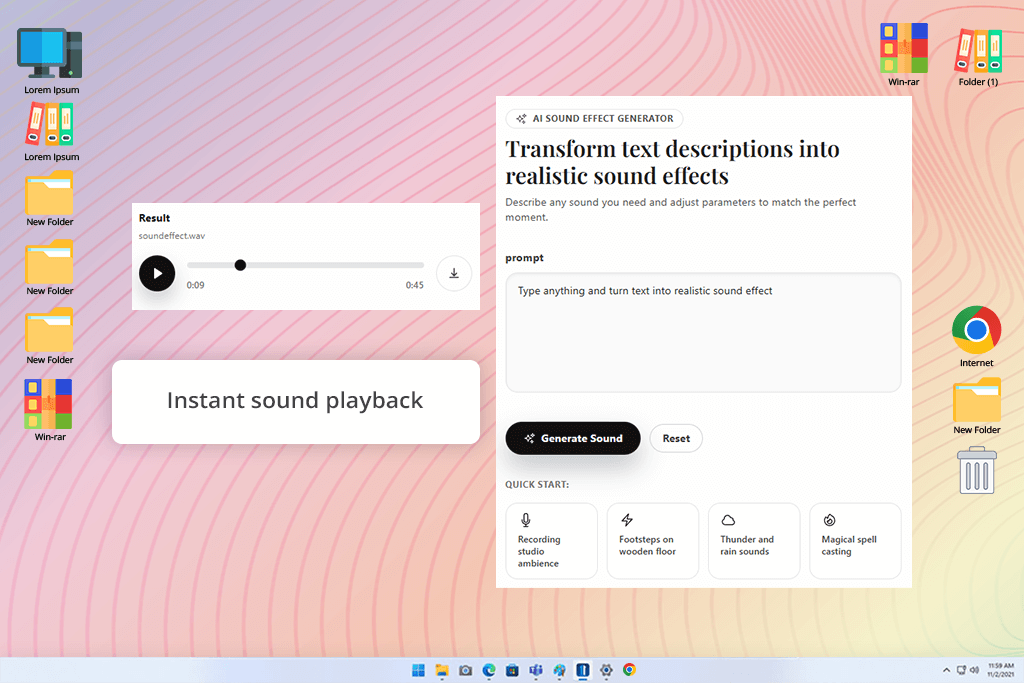

Ten generator dźwięku oparty na sztucznej inteligencji zrobił na mnie większe wrażenie, niż się spodziewałem. Interfejs jest przejrzysty i koncentruje się wyłącznie na zamianie tekstu na dźwięk. Wpisałem prosty opis: „deszcz na metalowym dachu z cichym grzmotem w oddali”, a w ciągu kilku sekund stworzyłem wiarygodny, użyteczny klip audio.

Najbardziej podobało mi się to, jak łatwa była w obsłudze – bez instalacji i skomplikowanych ustawień. Działa bezpośrednio w przeglądarce, więc każdy może zacząć od razu. Dźwięk generowany przez aplikację brzmiał czysto i naturalnie, z dobrą głębią i balansem tonów.

Zdecydowanie nie jest przeznaczony do pełnowymiarowego projektowania dźwięku ani do skomplikowanego miksowania – jest raczej dla twórców, którzy potrzebują szybkiego, gotowego do użycia dźwięku. Używałem go do szybkich edycji, krótkich filmów do mediów społecznościowych i tymczasowych dźwięków zastępczych w większych projektach.

To w zasadzie najłatwiejszy sposób na rozpoczęcie korzystania ze sztucznej inteligencji do obróbki dźwięku. Idealny dla początkujących i każdego, kto oczekuje szybkich rezultatów, a nie głębokiej kontroli. A jeśli użyjesz go razem z rogramem DAW dla początkujących, może stać się zaskakująco mocnym zestawem.

W dniu FixThePhoto przetestowaliśmy najpopularniejsze narzędzia do tworzenia efektów dźwiękowych oparte na sztucznej inteligencji, aby sprawdzić, które z nich faktycznie działają tak dobrze, jak reklamują. Pomysł był prosty – sprawdzić, czy te narzędzia mogą realnie skrócić czas poświęcany na ręczne projektowanie i edycję dźwięku, wykorzystując sztuczną inteligencję do wydajniejszego tworzenia dźwięku.

proces testowania był połączeniem kontroli technicznej i kreatywnej oceny. Każdy członek naszego zespołu (Nataly Omelchenko, Tata Rossi i Kate Debela) testował narzędzia z własnej, zawodowej perspektywy.

Nataly, specjalizująca się w montażu wideo i wizualnym opowiadaniu historii, skupiła się na tym, jak dobrze dźwięk generowany przez sztuczną inteligencję zgrywa się z rzeczywistym materiałem filmowym. Przesłała różne klipy, takie jak sekwencje z podróży, ujęcia lifestylowe, emocjonalne minifilmy, i oceniła, czy dźwięki pasują do tempa, nastroju i akcji rozgrywającej się na ekranie.

Tata skupiła się na tym, jak realistyczne i zrównoważone wydają się dźwięki. Słuchała, jak poszczególne warstwy ze sobą współgrają, czy głośność i ton brzmią naturalnie oraz czy dźwięk pasuje do obrazu bez konieczności dodatkowych poprawek. Zauważyła również, które narzędzia lepiej nadają się do tworzenia ogólnej atmosfery tła, a które są bardziej przydatne do uzyskania ostrych, szczegółowych efektów dźwiękowych.

Kate z kolei skupiła się na łatwości obsługi narzędzi. Sprawdziła, jak szybko każde z Narzędzia audio AI generuje dźwięk, czy sterowanie jest proste w obsłudze i jak płynnie dźwięki można dodawać do programów do edycji wideo. Sprawdziła również, jak dobrze narzędzia sprawdzają się u początkujących, którzy nie mają doświadczenia w projektowaniu dźwięku.

Wspólnie testowaliśmy każdy generator dźwięku AI w rzeczywistych, codziennych sytuacjach montażowych. Wykorzystaliśmy te same klipy wideo (od cichych scen ulicznych po szybkie, dynamiczne ujęcia) i porównaliśmy, jak każde narzędzie reagowało na ten sam opis lub nastrój. Niektóre generatory zachwyciły nas bogatym, wielowarstwowym, kinowym dźwiękiem, podczas gdy inne wyróżniały się przede wszystkim szybkością i łatwością obsługi.

Podczas testów nie tylko ocenialiśmy jakość finalnego dźwięku. Sprawdziliśmy również, jak łatwo każde z narzędzi wpasowuje się w standardowy proces pracy twórcy. Różnice były bardzo wyraźne: Firefly płynnie integrował się z innymi programami Adobe, ElevenLabs generował głosy, które brzmiały niezwykle realistycznie, silnik SFX umożliwiał bardzo precyzyjną kontrolę dźwięku, a Canva koncentrował się na szybkim, prostym tworzeniu dźwięku przy minimalnym wysiłku.

Po zakończeniu testów stało się oczywiste, że nie ma jednego idealnego narzędzia AI na każdą sytuację – każde sprawdza się najlepiej w różnych potrzebach. To, co naprawdę się wyróżniało, to zaawansowanie AI w zakresie dźwięku. Rezultaty były często zaskakująco naturalne i kreatywne, a my z niecierpliwością czekaliśmy na to, jak te narzędzia będą się rozwijać w przyszłości.