Ich arbeite als freiberuflicher Videoeditor und bin daher meist auf professionelle Software angewiesen, um Videos für Kundenprojekte zu optimieren und hochzuskalieren. Diese Programme liefern zwar hervorragende Ergebnisse, erfordern aber auch fundierte technische Kenntnisse, leistungsstarke Computer und viel Zeit zum Einarbeiten. Over die Jahre habe ich einen effizienten Workflow mit diesen Video-Upscaling-Tools entwickelt. Mir ist jedoch bewusst, dass ein solches Setup für die meisten Menschen nicht realisierbar ist.

In letzter Zeit haben uns viele Leser kontaktiert und gefragt, wie sie ähnliche Ergebnisse erzielen können, ohne teure Software kaufen oder komplizierte Bearbeitungstechniken für eine einzige Bearbeitung erlernen zu müssen. Es wurde deutlich, dass sich viele eine einfachere Lösung wünschten, um alte oder qualitativ minderwertige Videos mit minimalem Aufwand zu verbessern. Das hat mich dazu bewogen, die besten KI-gestützten Video-Upscaler zu untersuchen, die den Prozess automatisieren und die Videoverbesserung für jedermann zugänglich machen.

Um diese Liste zusammenzustellen, habe ich mit mehreren Teammitgliedern des FixThePhoto Team zusammengearbeitet. Gemeinsam testeten wir verschiedene KI-Tools in unterschiedlichen Situationen (darunter alte Familienaufnahmen und moderne HD-Clips, die einer zusätzlichen Bearbeitung bedurften). Wir stellten fest, dass die leistungsstärksten KI-Video-Upscaler weit mehr leisten als nur die Auflösung zu erhöhen: Sie können fehlende Details over , Rauschen reduzieren, Bewegungsunschärfen beheben und Schärfe und Farben verbessern – und gleichzeitig viele Stunden manueller Arbeit einsparen.

Obwohl KI-Video-Upscaler leistungsstarke Werkzeuge sind, stellen sie keine perfekte Lösung dar. Bei falscher Anwendung können sie unnatürlich wirkende Ergebnisse liefern. Während unserer Tests over den letzten Monaten sind mir einige Fehler aufgefallen, die Nutzer häufig bei der KI-gestützten Videoverbesserung begehen. Die gute Nachricht: Diese Probleme lassen sich leicht vermeiden, sobald man die Funktionsweise der Technologie verstanden hat.

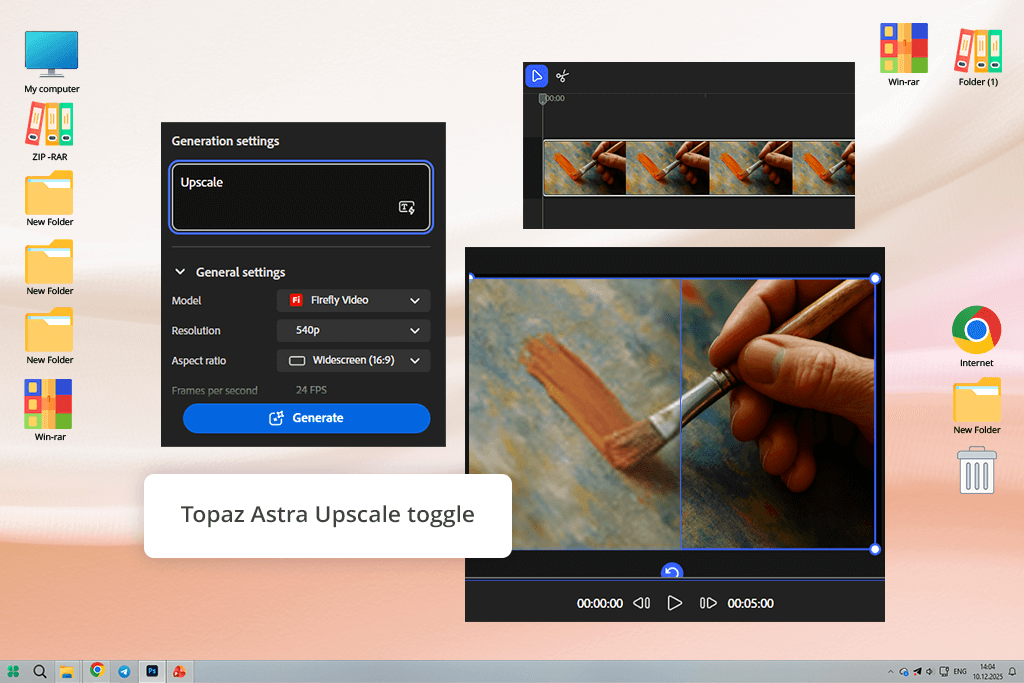

Ich vertraue Adobe-Produkten schon lange, daher wollte ich es unbedingt selbst ausprobieren, als ich erfuhr, dass Adobe Firefly KI-Video-Upscaling mit Topaz Astra integriert hat. Die Kombination des flüssigen, kreativen Workflows mit der bekannten KI-Upscaling-Technologie von Topaz erschien mir für Adobe ein logischer Schritt. Zum Testen verwendete ich zwei ältere Promo-Videos: eines in 720p und das andere in verrauschter 480p-Qualität, das auf modernen Bildschirmen veraltet wirkte.

Ich öffnete Firefly Boards, lud beide Videos hoch und folgte dem neuen Prozess. Nachdem ich einen Clip ausgewählt hatte, klickte ich auf das kleine Topaz Astra ico in der Bearbeitungswerkzeugleiste – man übersieht es leicht, wenn man es nicht kennt. Für das erste Video wählte ich den Modus „Präzise“ und stellte die Ausgabe auf 4K ein. Für den zweiten Clip wählte ich den Modus Firefly -Videomodell im Hintergrund die Videos bearbeitete, konnte ich ungestört die Farben anderer Dateien anpassen.

Die Endergebnisse waren beeindruckend. Der 720p-Clip wirkte scharf und klar und konnte ohne weitere Bearbeitung direkt auf YouTube hochgeladen werden. Das 480p-Video sah zwar nicht plötzlich wie echtes 4K aus, aber die Verbesserung reichte aus, um es im Markenvideo eines Kunden zu verwenden – ein deutlicher Fortschritt gegenüber dem Original. Mir gefiel auch, wie Astra Gesichter und Bewegungen natürlich darstellte, ohne den künstlichen, glatten Look zu erzeugen, den manche KI-Video-Upscaler produzieren. Der größte Nachteil für mich war, dass die Verarbeitung von Videos mit höherer Auflösung länger dauerte als erwartet.

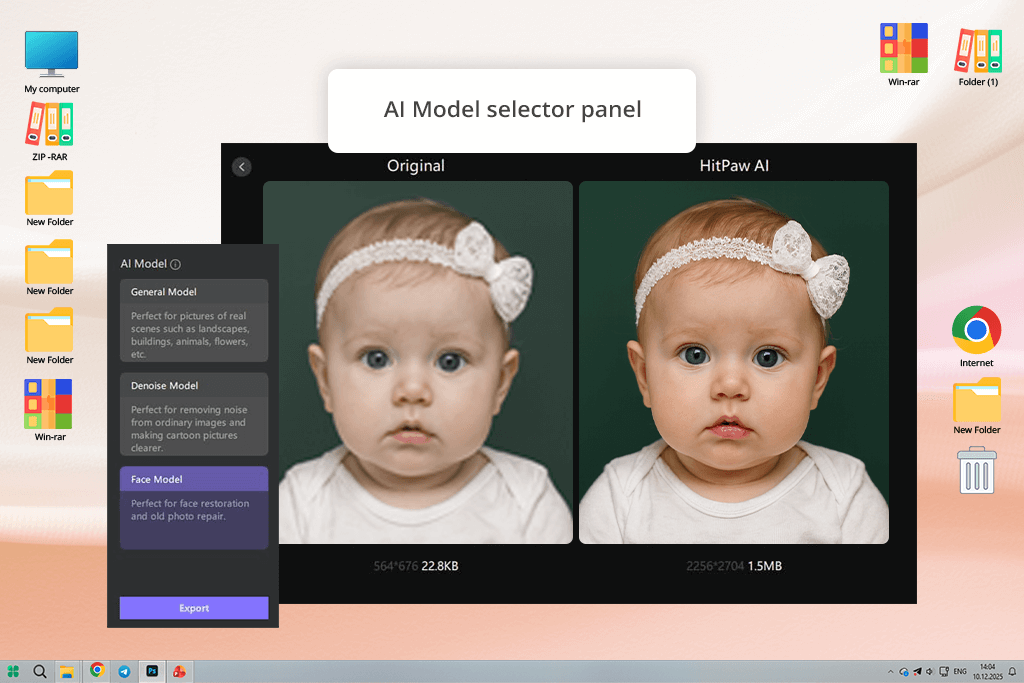

Ich hätte HitPaw wahrscheinlich nicht getestet, wenn meine Kollegin Nataly es nicht beiläufig mention hätte. Sie beschrieb es als einfaches Tool, das jeder bedienen kann, auch ohne Vorkenntnisse in der Videobearbeitung. Deshalb beschloss ich, es als Beispiel für eine benutzerfreundliche Option auszuprobieren. Ich lud die Desktop-Version herunter, da die Online-Version des KI-Video-Upscalers die Anzahl der hochgeladenen Dateien beschränkt. Anschließend testete ich HitPaw mit zwei verschiedenen Videos: einem Interview und einem kurzen animate Erklärvideo.

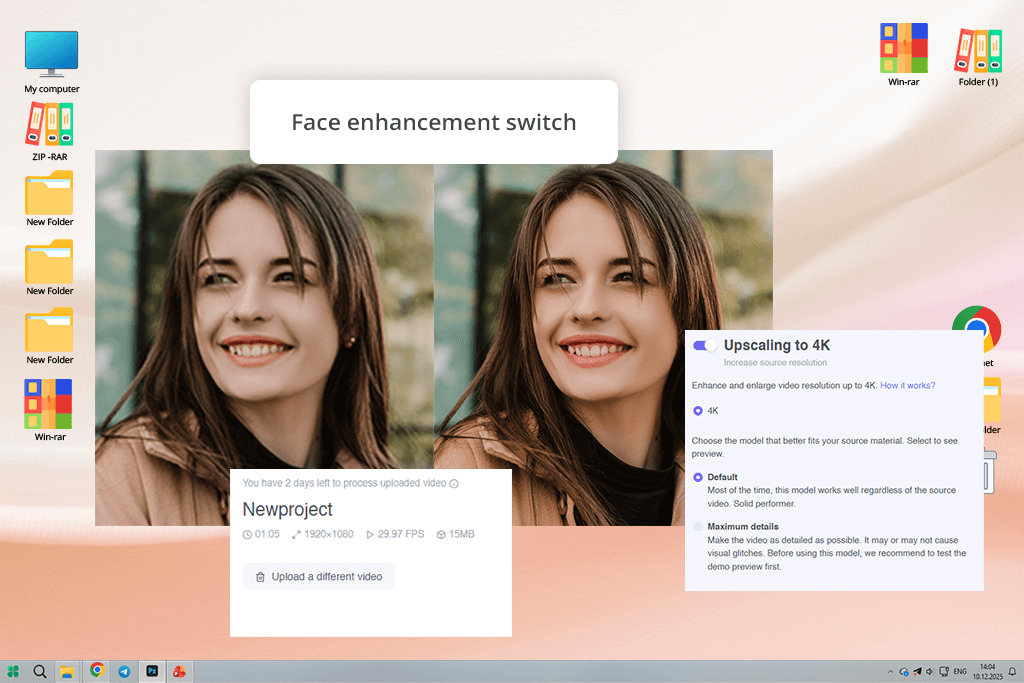

Als Erstes fiel mir die einfache Bedienung auf: Man lädt sein Video hoch, wählt ein KI-Modell (Allgemein, Gesicht, Animation oder UHD) und klickt dann auf „Verbessern“. Ich habe das Gesichtsmodell für den Interviewausschnitt verwendet. Es verbesserte schnell die Helligkeit und stellte Gesichtsdetails klarer dar, ganz ohne manuelle Anpassungen. Bei genauerer Betrachtung des Videos bemerkte ich jedoch kleine Bildfehler an den Rändern bei schnellen Kopfbewegungen. Mit dem allgemeinen Modell wirkte das Video flüssiger und cons .

Anschließend testete ich das Animationsmodell anhand des Erklärvideos, und es schnitt gut ab. Die Farben wirkten leuchtender, die Linien schärfer, und das 4K-Upscaling sah professionell aus, insbesondere für ein Tool, das keine manuellen Anpassungen erfordert. Allerdings empfand ich die Verarbeitungsgeschwindigkeit als langsam, und die kostenlose Testversion war sehr eingeschränkt, was einen umfassenden Test der Software erschwerte. Nach dem Kauf des Abonnements verbesserte sich die Leistung jedoch deutlich: Die Verarbeitung erfolgte schneller, die Exportqualität war besser und die KI-Ergebnisse insgesamt flüssiger.

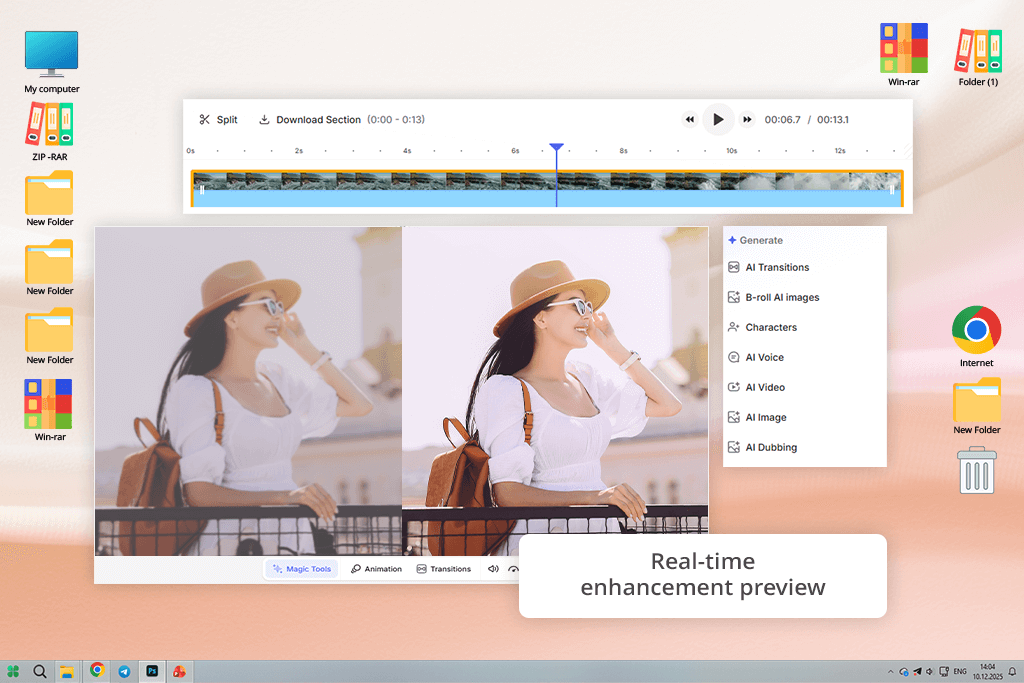

VEED ist eines meiner bevorzugten Tools, wenn ich kurze Videos für Social Media bearbeiten oder hochskalieren muss. Da ich häufig Inhalte für Instagram und YouTube Shorts erstelle, schätze ich besonders, dass alles direkt im Browser funktioniert. Es ist keine Installation nötig, kein leistungsstarker Computer erforderlich und es gibt keinerlei technischen Stress. Ich kann mich mit meinem Laptop in ein Café setzen, ein Video hochladen und sofort mit der Bearbeitung beginnen.

Als ich den KI-Enhancer von VEED ausprobierte, gefiel mir, wie nahtlos er sich in den gesamten Bearbeitungsprozess einfügte. Ich lud mehrere Behind-the-Scenes-Videos von einem shoot hoch und nutzte KI-Upscaling in Kombination mit Rauschunterdrückung und Farbkorrektur. Besonders praktisch ist die Live-Vorschau: Man sieht, wie das Video beim Anpassen der Einstellungen klarer und heller wird. Auch die Möglichkeit, Untertitel, Schnittfunktionen und grundlegende Bearbeitungen im selben Arbeitsbereich vorzunehmen, finde ich sehr hilfreich.

VEED hat allerdings auch seine Grenzen. Es eignet sich gut für Marketer und Content-Ersteller, die Wert auf Geschwindigkeit legen, doch die kostenlose Version schränkt die Exportqualität ein, und alles ist von einer guten Internetverbindung abhängig. Offline-Arbeiten ist gar nicht möglich. Trotzdem ist VEED stark in der Teamarbeit und bei schnellen Bearbeitungen. Ich sende meinen Teamkollegen oft Vorschauversionen über den gemeinsamen Arbeitsbereich, und es ist eines der benutzerfreundlichsten Kollaborationssysteme, die ich je in einem Online-Editor verwendet habe.

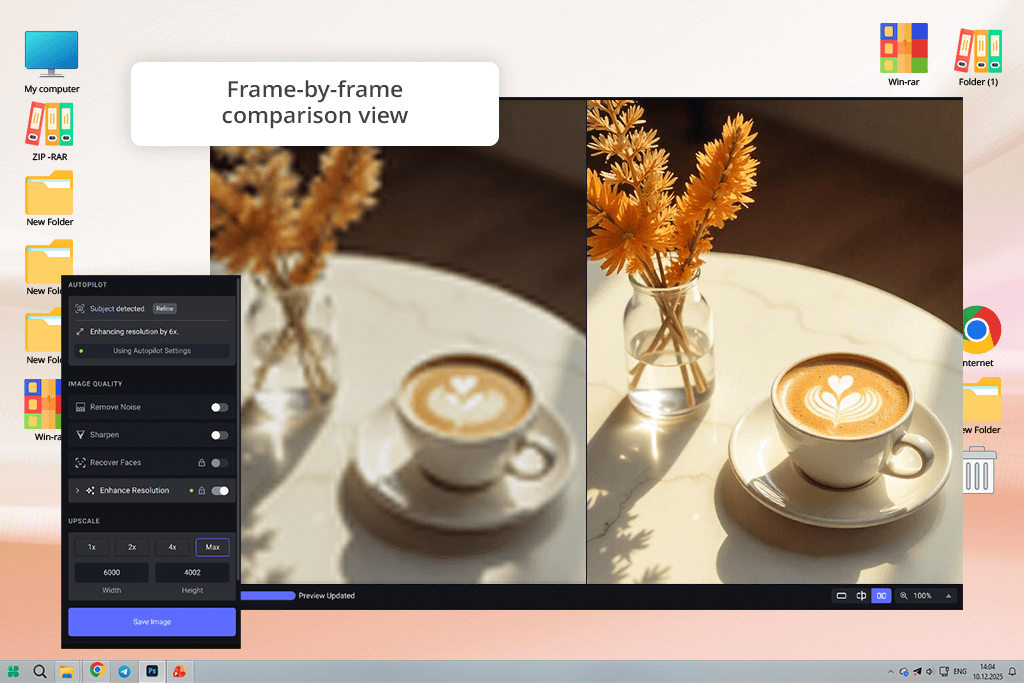

Da Adobe Firefly Topaz -Technologie nutzt, wollte ich Topaz Video AI einmal eigenständig testen. Firefly bietet zwar eine übersichtliche und geführte Benutzererfahrung, aber ich war neugierig, Topaz Video AI uneingeschränkt nutzen zu können. Ich installierte es auf meinem Hauptrechner und testete es mit verschiedenen Videomaterialien, darunter verwackelte Handaufnahmen, dunkle Innenaufnahmen und alte Interlaced-Videos einer DSLR-Kamera.

Was sofort ins Auge fiel, war der hohe Grad an Kontrolle Topaz bietet. Anstelle eines einzelnen „Verbessern“-Buttons wählt man spezifische KI-Modelle wie Artemis, Proteus oder Iris aus, passt die Regler an und vergleicht die Ergebnisse Bild für Bild. Für einen Clip bei schlechten Lichtverhältnissen testete ich zwei Modelle nacheinander, um zu sehen, wie sie mit Rauschen und Bewegungen umgehen. Die Vorschau im direkten Vergleich machte die Unterschiede deutlich sichtbar: Das eine Modell bewahrte mehr Details, während das andere für flüssigere Bewegungen sorgte.

Topaz -Software benötigt allerdings leistungsstarke Hardware. Das Rendern von Videos beansprucht viel Systemleistung, und meine Grafikkarte wurde bei großen Exporten stark beansprucht. Dennoch hat sich der Aufwand gelohnt. Die fertigen Videos wirkten filmisch und überhaupt nicht künstlich. Kanten blieben scharf, Bewegungen flüssig und Farben natürlich. Dieser KI-Video-Upscaler ist nicht ideal für schnelle Bearbeitungen in sozialen Medien, aber für Kreative, die Wert auf detailgetreue Bildqualität legen, ist Topaz kaum zu übertreffen.

Man würde Adobe Premiere Pro hier vielleicht nicht erwarten, da es eher als professionelles Schnittprogramm denn als einfaches KI-Tool bekannt ist. Adobe hat jedoch over der Zeit immer mehr KI-Funktionen hinzugefügt, und die Upscaling-Option in Premiere Pro ist ein gutes Beispiel dafür. Ich nutze Premiere seit Jahren für Farbkorrektur und Multikamera-Bearbeitung und habe mich kürzlich entschlossen, den detailerhaltenden Upscaling-Effekt genauer unter die Lupe zu nehmen.

Ich habe ein älteres 720p-Produktvideo importiert. Im Effekte-Bedienfeld suchte ich nach „Detailerhaltendes Upscaling“, wandte es an und erhöhte die Skalierung auf 200 %, um eine nahezu 4K-Qualität zu erreichen. Am meisten beeindruckte mich die Kontrollmöglichkeit. Anstatt alles der KI zu überlassen, konnte ich die Rauschunterdrückung und die Texturdetails selbst anpassen. Die Rauschunterdrückung funktionierte einwandfrei und entfernte Pixel, während Text und Gesichter scharf blieben.

Premiere Pro ist nicht günstig und die Einarbeitung erfordert Zeit. Wenn Sie es aber bereits über ein Adobe-Abonnement besitzen, brauchen Sie kein anderes Video-Upscaling-Tool. Es ist zuverlässig, flexibel und bietet Ihnen die volle Kontrolle over jedes einzelne Bild – genau das, was man von professioneller Software mit integrierten KI-Funktionen erwartet.

Ich hätte Neural Love wahrscheinlich nicht von selbst entdeckt. Meine Kollegin Tati sah eine Anzeige dafür und schlug vor, es auszuprobieren. Wir entschieden uns für einen kurzen, aber aussagekräftigen Test mit kurzen Handyvideos und Clips im Social-Media-Stil, da unsere Leser am häufigsten nach solchen Dateitypen fragen. Ziel war es, herauszufinden, ob ein vollständig browserbasiertes KI-Tool zur Video-Hochskalierung ohne spezielle Hardware akzeptable Ergebnisse liefern kann.

Die Nutzung von Neural Love war kinderleicht. Ich habe ein vertikales Video direkt über die Website hochgeladen, die gewünschten Optimierungsoptionen ausgewählt und den Rest der cloudbasierten KI überlassen. Es gab keine komplizierten Einstellungen oder Regler. Das Tool verbesserte automatisch Schärfe, Beleuchtung und Gesichtsdarstellung. Nach Abschluss der Bearbeitung wirkte das Video heller und klarer. Gesichter waren besser zu erkennen und dunkle Bereiche erschienen ausgeglichener.

Die gleiche Einfachheit kann jedoch auch ein Nachteil sein. Die Stärke des KI-Effekts ließ sich nicht steuern, und bei komplexerem Videomaterial hätte ich mir erweiterte Optionen gewünscht. Die kostenlose Version beschränkt zudem die Dateigröße, wodurch sich das Tool eher für kurze oder mittellange Videos als für große Projekte eignet. Dennoch hält Neural Love , was es verspricht, wenn man als Kreativer eine schnelle, komplett online funktionierende Lösung sucht.

Ich habe Gigapixel mit einem bestimmten Ziel vor Augen getestet. Manchmal arbeiten wir mit Videos, bei denen flüssige Bewegungen wichtiger sind als extreme Schärfe. Daher habe ich anstelle von zufälligen Clips ein kurzes, filmisches Video mit Kamerabewegungen und feinen Details verwendet – genau die Art von Material, bei der KI-Tools oft mit Flimmern oder instabilen Texturen zu kämpfen haben.

Gigapixel behandelt Videos eindeutig als durchgehende Sequenz und nicht als einzelne Bilder. Ich habe die Timeline Bild für Bild durchgesehen, und die Details blieben konstant, ohne flackernde Texturen oder seltsame Kantenverzerrungen. Selbst in Szenen mit viel Bewegung wirkte das KI-gestützte Video-Upscaling kontrolliert und cura . Ich war auch beeindruckt, wie gut es mit komprimierten Videos umging, Blockartefakte reduzierte und gleichzeitig wichtige Details bewahrte.

Gigapixel wirkt jedoch wie eine Software für professionelle Postproduktionsmitarbeiter und nicht für den schnellen oder gelegentlichen Einsatz. Die Verarbeitungszeiten verlängerten sich bei höheren Bildraten, und die Benutzeroberfläche setzt voraus, dass man bereits mit Themen wie Auflösung, Videoformaten und Exporteinstellungen wie ProRes vertraut ist.

Um unsere Tests fair und praxisnah zu gestalten, konzentrierten wir uns auf Funktionen, die beim Video-Upscaling in der Praxis relevant sind, und nicht auf Marketingversprechen. Zunächst Testen ich, wie gut die einzelnen Tools die Auflösung skalierten, insbesondere gängige Upgrades wie 720p auf 1080p und 1080p auf 4K. Ich untersuchte genau, ob die KI feine Details wie Gesichter, Text und Kanten beibehielt oder ob sie künstlich wirkende Texturen erzeugte, die zunächst scharf erscheinen, bei genauerem Hinsehen aber zerfallen.

Die Bewegungsstabilität war ein weiterer Schwerpunkt. Nataly analysierte Clips mit Kamerabewegungen, Handgesten und schnellen Szenenwechseln und prüfte die cons von Bild zu Bild. Flackern, unruhige Kanten und pulsierende Texturen sind häufige Probleme bei KI-Upscaling. Daher ging sie das Material Bild für Bild sorgfältig durch, um Fehler zu erkennen, die bei normaler Wiedergabe möglicherweise nicht auffallen.

Tati konzentrierte sich darauf, wie die einzelnen Tools mit Rauschen und visuellen Fehlern umgingen. Sie testete Videos bei schlechten Lichtverhältnissen, komprimierte Clips und ältere Aufnahmen, um zu prüfen, ob die KI das Rauschen reduzieren konnte, ohne Details zu verwischen oder Kompressionsartefakte zu verstärken. In verschiedenen Situationen verglich sie unterschiedliche Stärkestufen, um den Punkt zu ermitteln, an dem die Verbesserung aufhörte und das Video überbearbeitet wirkte.

Das Farbverhalten war ebenfalls wichtig. Ich achtete auf Veränderungen von Helligkeit, Kontrast und Sättigung und überprüfte, ob die Hauttöne nach dem Hochskalieren noch natürlich aussahen.

Abschließend überprüften wir die Effizienz der einzelnen KI-Video-Upscaler, einschließlich Verarbeitungsgeschwindigkeit, cura der Vorschau, Zuverlässigkeit beim Export und der Integration der Software in reale Bearbeitungsabläufe anstelle isolierter Testszenarien. Diese Methode ermöglichte es uns, unsere Schlussfolgerungen auf der alltäglichen Leistung anstatt auf einmaligen Tests zu gründen.