Jag har arbetat med videoredigering länge, men ljuddesign har alltid varit den svåraste delen för mig. Jag kan spendera timmar med att leta efter rätt ljudeffekt – oavsett om det är ett dramatiskt sus, ett sprakande ljud från en öppen spis eller en mild bakgrundston – och ändå inte hitta en som passar. De flesta ljudbibliotek är överprissatta, för enkla eller helt enkelt inte riktigt rätt.

Förra veckan arbetade jag på en kort resevideo. Bilderna var klara – färgerna, klippningarna och övergångarna såg bra ut – men när jag tittade på den kändes den platt. Den hade ingen atmosfär. Det var då det slog mig: Jag behövde inte bara bakgrundsljud, jag behövde ljud som stödde berättelsen.

Så jag började leta efter en AI-ljudgenerator som faktiskt kunde förstå vad jag bad om, istället för att ge mig slumpmässiga ljudeffekter.

Här är vad jag ville ha:

Efter att ha testat flera verktyg insåg jag att de flesta så kallade "AI"-plattformar bara återanvände standardljudbibliotek. Men ett verktyg stack ut – det genererade faktiskt ljudet från själva prompten. När jag gick in i "gammal metalldörr som långsamt öppnas i en mörk hall" producerade det ett ljud som kändes äkta, detaljerat och matchade min scen perfekt.

För första gången kämpade jag inte med att anpassa ljudet till min video – jag formade ljudet till min berättelse.

Nu, istället för att spendera timmar på att söka igenom ljudbibliotek, beskriver jag bara ljudet jag vill ha – som "mjukt regn som knackar mot glas på kvällen" – och AI:n skapar det på några sekunder.

Jag bestämde mig för att välja de bästa verktygen för mig själv och dela dem i den här artikeln. För att göra det bad jag mina kollegor från FixThePhoto-teamet om hjälp. Vi valde ut flera projekt – några från mitt professionella arbete och några livsstilsvideor för sociala medier gjorda av mina kollegor.

Vi skrev ner vad varje projekt behövde och började utforska olika ljudgeneratorer. Vi kollade forum, tittade på rekommendationer och började sedan testa varje verktyg.

Bra videoljud startar inte på datorn. Det börjar i ditt huvud. Först, förstå känslan i din berättelse Varje scen har en unik känsla, som lugn, energisk eller mystisk. När du vet vilken känsla du vill ha kan du utforma ljudet för att skapa den, snarare än att bara lägga till den som ett sista steg.

Att skapa ljud till dina videor är enklare nu tack vare AI. Du behöver inte längre söka igenom oändliga ljudbibliotek. beskriv känslan, scenen eller atmosfären du försöker skapa, och AI:n bygger ljudet åt dig. Att vara specifik med din beskrivning ger dig bästa resultat.

Samma regel gäller för röster. Välj en röst som matchar din videos stil: en stark, tydlig röst för en handledning; en mjuk, långsam röst för en sorglig historia; eller en energisk röst för ett snabbt klipp. Tack vare AI låter dessa röster nu naturliga och verkliga, och passar perfekt till din video.

När du har din berättarröst och ljudeffekter sker det riktiga arbetet under redigeringen. Att justera volym, timing och hur ljuden passar in i videon hjälper till att få allt att kännas naturligt och levande. små detaljer – lätt bakgrundsbrus, ett mjukt eko eller små EQ-justeringar – kan få ljudet att kännas som att det verkligen hör hemma i scenen.

I slutändan handlar det inte bara om vilka verktyg du använder för att få bra ljud. Det handlar om att förstå stämningen och budskapet i din video. När du förstår berättelsen och känslan du vill förmedla, hjälper AI dig helt enkelt att uttrycka den. Ljuddesignen slutar vara ett tekniskt problem och blir en smidig del av berättandeprocessen.

| Att göra | Att inte göra |

|---|---|

|

✔️ stämningen och känslan i din video innan du gör ljudet.

|

❌ inte generera ljud utan att veta vilken atmosfär du vill ha.

|

|

✔️ Skriv detaljerade uppmaningar med tydliga beskrivningar.

|

❌ Använd korta eller vaga uppmaningar som ”bakgrundsmusik” eller ”röst”.

|

|

✔️ en röststil och ett tempo som passar det visuella och budskapet.

|

❌ Använd samma röstläge för varje projekt.

|

|

✔️ timing, volym och blandning när du redigerar ljud.

|

❌ inte till ljud utan att synkronisera dem med videon.

|

|

✔️ till små omgivande ljud för att få scenen att kännas verklighetstrogen.

|

❌ Låt ljudet kännas tomt eller för rent.

|

|

✔️ AI som ett verktyg för att stödja din kreativitet.

|

❌ Förvänta inte att AI ska göra allt det kreativa arbetet åt dig

|

När jag öppnade Adobe Firefly-video för första gången visste jag inte vad jag skulle förvänta mig. Jag hade hört mycket om det, men jag hade aldrig riktigt utforskat vad det kunde göra – särskilt eftersom jag vanligtvis sökte efter ljud och berättarröst manuellt i standardbibliotek.

Jag valde att testa det på ett projekt som hade varit svårt för mig: en dramatisk scen med en person som går genom en tom stad i solnedgången. Normalt sett skulle jag spendera lång tid med att söka igenom ljudbibliotek efter fotsteg, vind och mjuk stadsatmosfär – och även då skulle jag förmodligen hamna med något som inte kändes helt rätt.

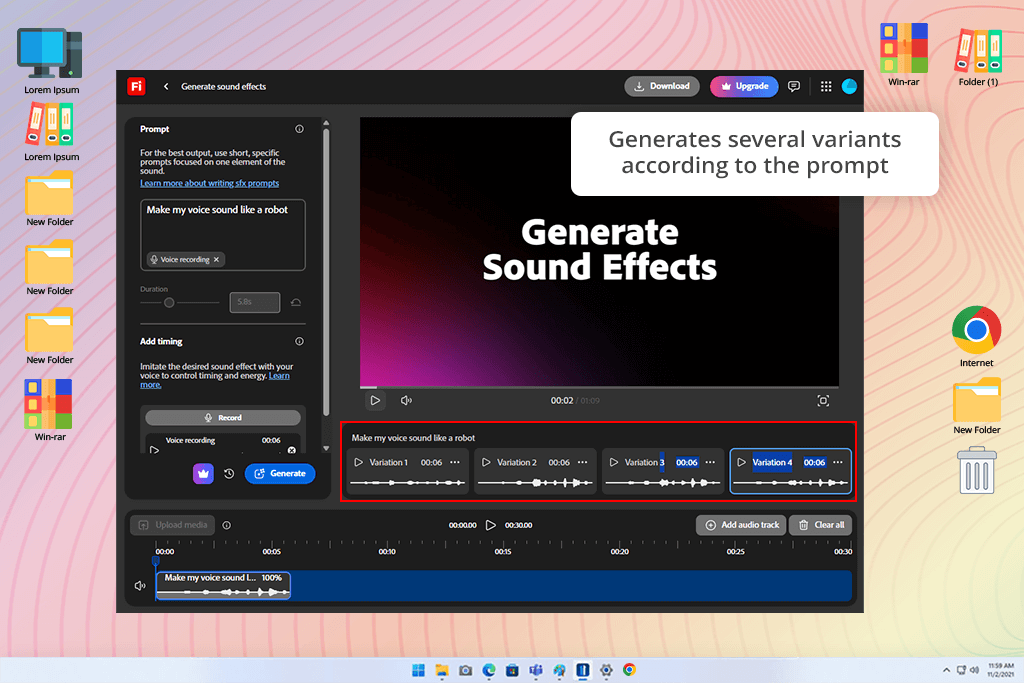

Jag matade in en detaljerad prompt i den här ljudeffektgeneratorn: ”Ekande fotsteg på en lugn stadsgata i solnedgången, mild vind, svaga sirener långt borta, filmisk stämning.” På bara några sekunder genererades flera ljudversioner. Kvaliteten överraskade mig – fotstegen hade en realistisk takt och tyngd, vinden skapade atmosfär utan att dränka något, och de avlägsna sirenerna tillförde en subtil spänning. Resultatet kändes rikt och mångbottnat, inte som ett kort ljud som upprepas overoch mer.

Sedan kontrollerade jag hur mycket jag kunde justera ljudet. Jag kunde ändra hur stark vinden lät i den här gratis Adobe-programvara, lägga till eller minska eko för att få fotstegen att verka närmare eller längre bort, och till och med separera olika delar av ljudmixen.

Jag placerade ljudet som Firefly skapade direkt i min videotidslinje. Det matchade bilderna perfekt, och scenen kändes omedelbart mer verklig. Gränssnittet gjorde det enkelt att prova olika versioner – jag kunde generera, lyssna, justera och byta ljud utan att lämna min redigeringsyta.

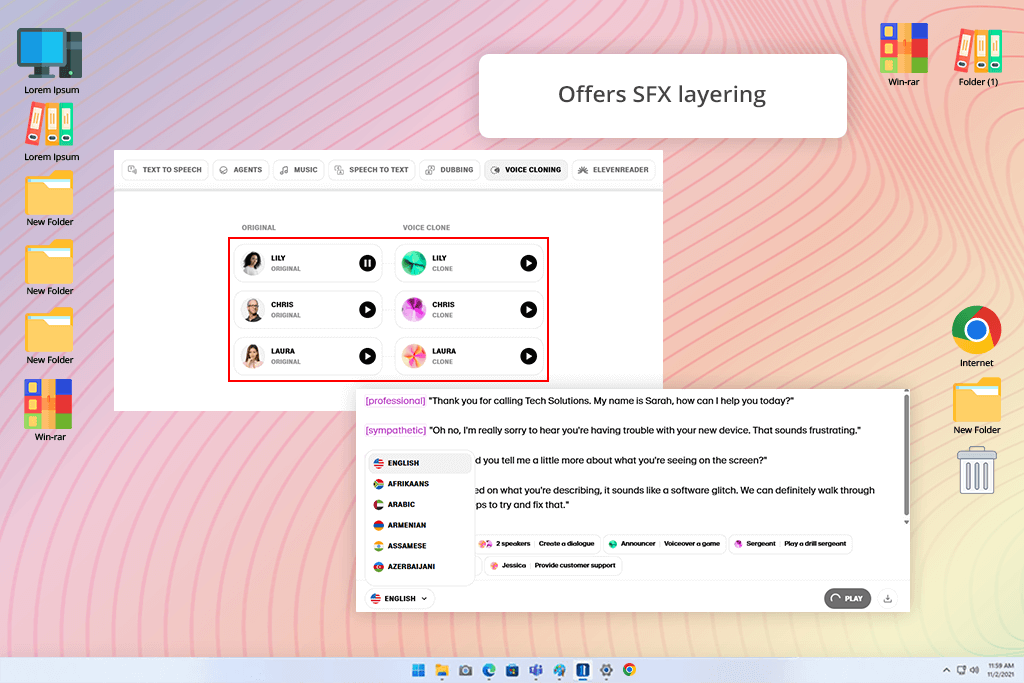

Jag testade ElevenLabs på en scen som behövde en berättarröst för en kort dokumentär. Jag skrev en kort prompt som beskrev tonen jag ville ha: lugn, tydlig och stadig. På bara några sekunder genererade ElevenLabs en berättarröst som lät väldigt naturlig – rytmen, betoningen och till och med de små andetagen kändes realistiska.

Det som framför allt imponerade på mig var hur enkelt jag kunde justera röstdetaljerna. Jag kunde ändra hastighet, ton och betoning utan att använda något komplicerat gratis ljudredigeringsprogram som jag använde tidigare. För ljudeffekter försökte jag lägga till saker som vind och lätt regn.

Även om ElevenLabs huvudsakligen är utformat för röster, passade de omgivande ljuden som skapades bra till min video. Sammantaget är ElevenLabs ett utmärkt val om ditt projekt mestadels bygger på berättarröst, med möjlighet att lägga till bakgrundseffekter vid behov.

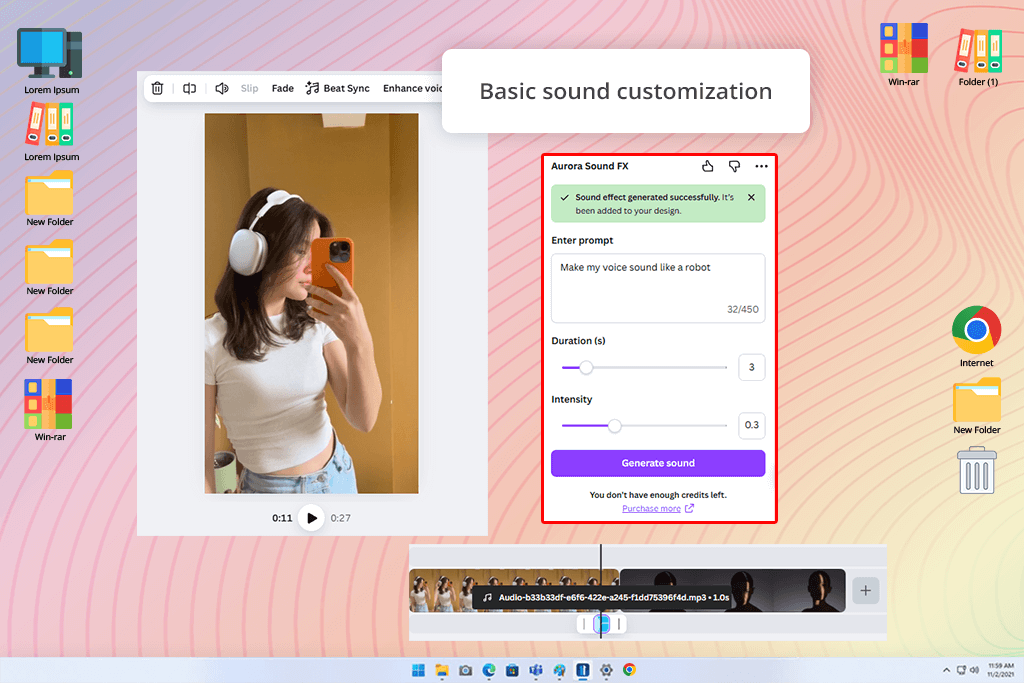

Jag trodde inte att canva skulle vara stark på ljudskapande, men dess AI-ljudfunktioner visade sig vara väldigt enkla att använda. Jag laddade upp ett kort reklamklipp och behövde ett mjukt bakgrundsljud – en mjuk bris och lätta klockljud för att matcha den upplyfta stämningen.

canva lät mig ange en kort beskrivning, och det producerade snabbt flera ljudalternativ som jag kunde förhandsgranska och placera direkt på tidslinjen.

Den största fördelen är hur enkelt och sammankopplat allt känns. Du behöver inga ljudkunskaper – AI:n ger dig flera färdiga ljudalternativ som du kan placera direkt i ditt Canva-projekt. Den är inte utformad för detaljerad ljudredigering, utan för snabbt och bekvämt arbete där du vill att ljudet ska matcha dina bilder direkt, vilket är perfekt för marknadsföring och videor i sociala medier.

Det bästa är att du kan göra allt i en och samma redigerare. Ingen export, inget byte av appar och ingen användning av separata AI-musikgeneratorer. För att skapa snabbt innehåll för sociala medier är det otroligt hjälpsamt.

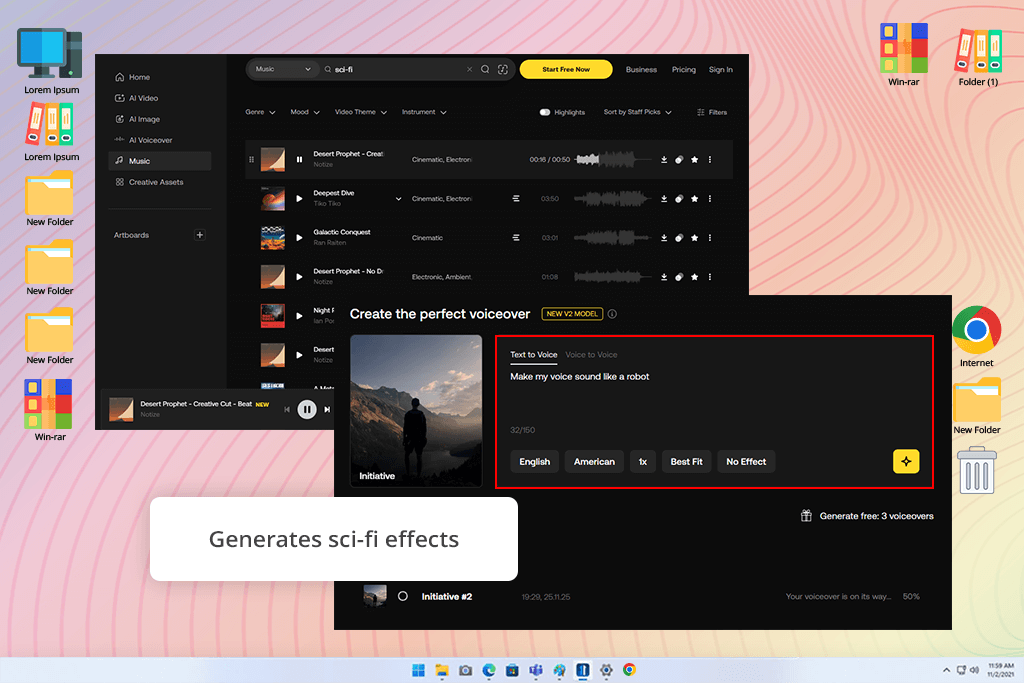

SFX Engine kändes som att använda en professionell ljudeffektgenerator. Jag testade det genom att bygga sci-fi-ljud i lager – laserskott, metallstötar och ett lågt rymdskeppsbakgrundsbrum. Verktyget lät mig ändra saker som tonhöjd, eko och var ljudet sitter i rymden, vilket gav mig en kontrollnivå som jag normalt bara hittar i fullständiga gratis DAW:er.

Det mest slående var hur autentiska ljuden kändes. Många AI-verktyg producerar repetitiva eller platta effekter, men SFX Engine skapade ljud som lät fylligt och filmiskt, som något hämtat direkt från ett professionellt filmsoundtrack.

SFX Engine är inte den bästa AI-röstgeneratorn för att skapa snabba klipp från sociala medier. Den är för kreatörer som filmskapare, animatörer och spelutvecklare som vill ha total kontroll och realistiskt ljud. Nackdelen är att det tar tid att lära sig och kräver en kraftfull dator. Men om du vill ha ljud av professionell kvalitet är det ett av de bästa verktygen som finns.

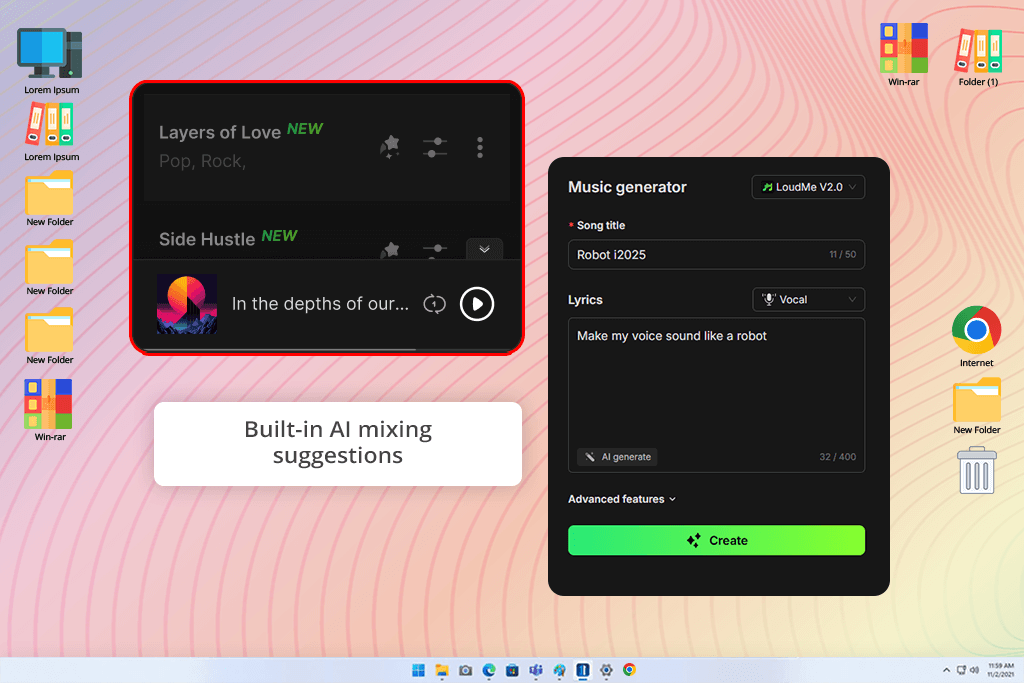

Att använda LoudMe kändes som att ha en hjälpare som redan förstår atmosfären jag försöker skapa. Jag redigerade ett kafé vlog och ville ha bakgrundsljud som kändes äkta men inte tog bort uppmärksamheten – tysta samtal, kaffemaskiner, ljud från lätta tallrikar.

Jag skrev en beskrivning av miljön, och på några sekunder gav LoudMe mig flera versioner att välja mellan. Var och en hade en annan nivå av bakgrundsljud och ton. Jag valde den som lät mest naturlig och placerade den i min redigering – den matchade perfekt utan några extra justeringar.

Det bästa var att detta röstöverföringsprogram automatiskt föreslog rätt volymbalans baserat på ljudet i min video. Jag behövde inte justera bakgrundsljudet och talet manuellt.

Det är inte det mest avancerade alternativet för detaljerad ljudredigering, men det är utmärkt för snabba, realistiska resultat. För vloggare, kreatörer eller alla som arbetar snabbt ger LoudMe en ren, naturlig atmosfär med nästan inget extra arbete.

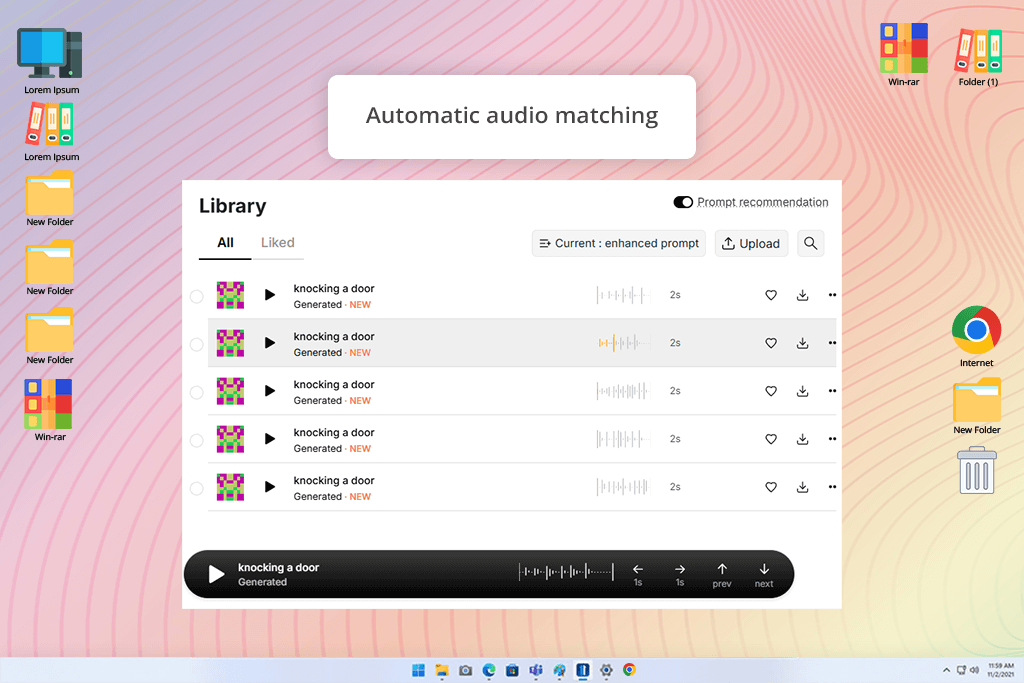

OptimizerAI stack ut för mig eftersom det påstår sig skapa ljud som automatiskt anpassar sig till bilderna. Jag ville se om det faktiskt kunde analysera en video och producera ljud som matchar scenen. Jag såg också folk på forum säga att det fungerar bra för att skapa animerade röster, så jag ville testa det också.

Jag laddade upp en kort stridsscen från ett av mina projekt – snabba skott, svärdsträffar och tunga fotsteg. OptimizerAI läste automatiskt av timing och rörelse i videon. Sedan, efter att jag angett en kort prompt som "intensiv medeltida stridsatmosfär", skapade den ljudeffekter som matchade handlingen direkt.

Det som förvånade mig mest var hur AI:n synkroniserade ljuden med handlingen på egen hand – fotsteg matchade rörelsen, stötarna träffade gungorna exakt och bakgrundsekot skiftade naturligt. Jag behövde knappt justera någonting.

KlingAI är skapat för kreatörer som vill ha ljud som känns fantasifullt och overkligt. Jag testade den här AI-röstgeneratorn over på en drömsk animation och behövde ljud som kändes mjukt och flytande. Jag skrev en kort prompt: "mjuka klockspel med djupa surrande toner och långsamma, vågliknande pulser."

Några sekunder senare producerade KlingAI ljud som kändes nästan levande. De lät inte som vanliga effekter man hittar på typiska royaltyfria musiksajter. Istället hade de djup och atmosfär. Jag kombinerade några av de genererade klippen, och slutresultatet kändes originellt – något jag inte kunde få från ett vanligt ljudbibliotek.

KlingAI är inte utformat för naturliga eller bokstavliga ljudmiljöer – det fokuserar på uttrycksfullt, atmosfäriskt ljud. Det fungerar bäst för konstnärliga öppningar, stämningsövergångar eller experimentella filmer där du vill ha något känslosamt och distinkt.

Nackdelen är att resultaten kan variera, och du kan behöva regenerera några gånger för att få exakt den känsla du vill ha. Men när resultatet stämmer överens levererar det något alldeles speciellt.

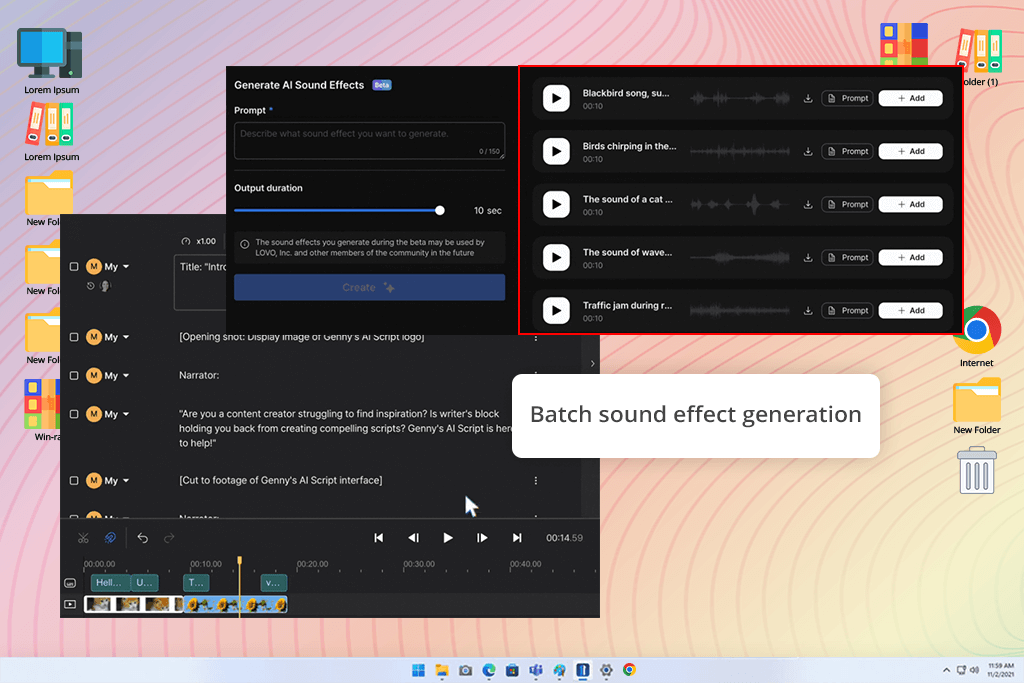

Jag testade Genny när jag arbetade med ett 2D-animationsprojekt som hade flera korta scener. Jag behövde en rad olika ljud som fotsteg, dörröppningar, skratt och bakgrundsljud från staden, men jag hade inte tid att skapa varje ljud separat.

Gennys batchfunktion överraskade mig verkligen. Jag matade in flera prompter samtidigt, och den producerade många ljudeffekter i ett enda svep. Alla ljud matchade bra och var redan balanserade och tydliga, vilket är sällsynt när man använder programvaror för artificiell intelligens utan extra redigering.

Den är utformad för att fungera snabbt och smidigt. Att växla mellan olika ljudversioner tog nästan ingen tid, så jag kunde testa alternativ utan att avbryta min redigeringsprocess.

Genny är inte avsett för djupgående, detaljerad ljudredigering, men det är perfekt för animatörer, YouTubers och små kreatörer som behöver mycket ljud av god kvalitet på några minuter. Det är lätt att använda, pålitligt och sparar mycket tid.

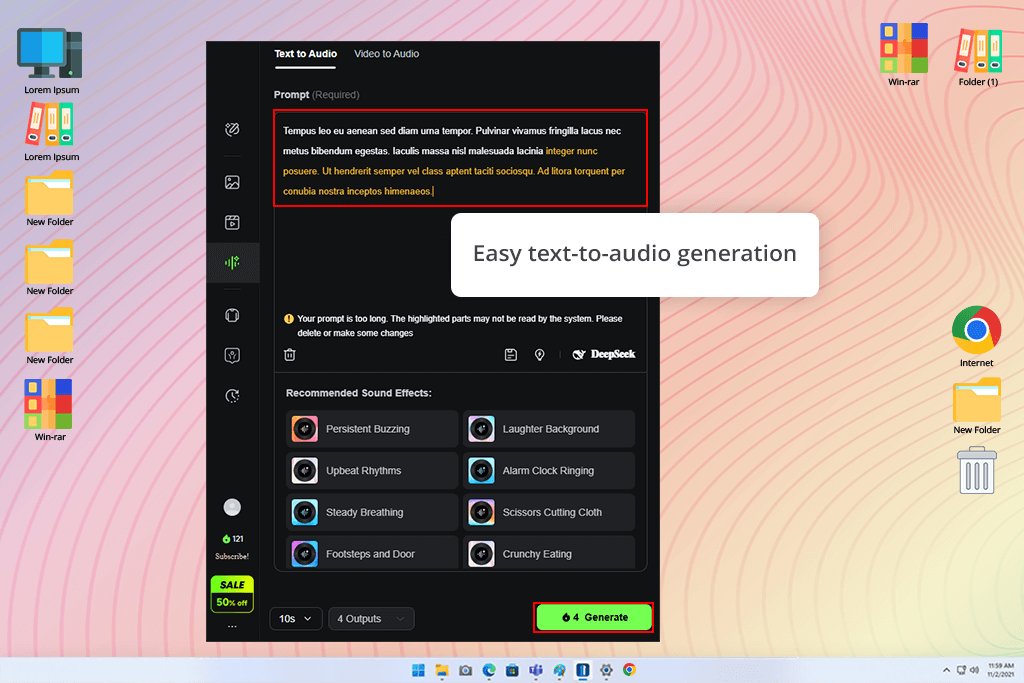

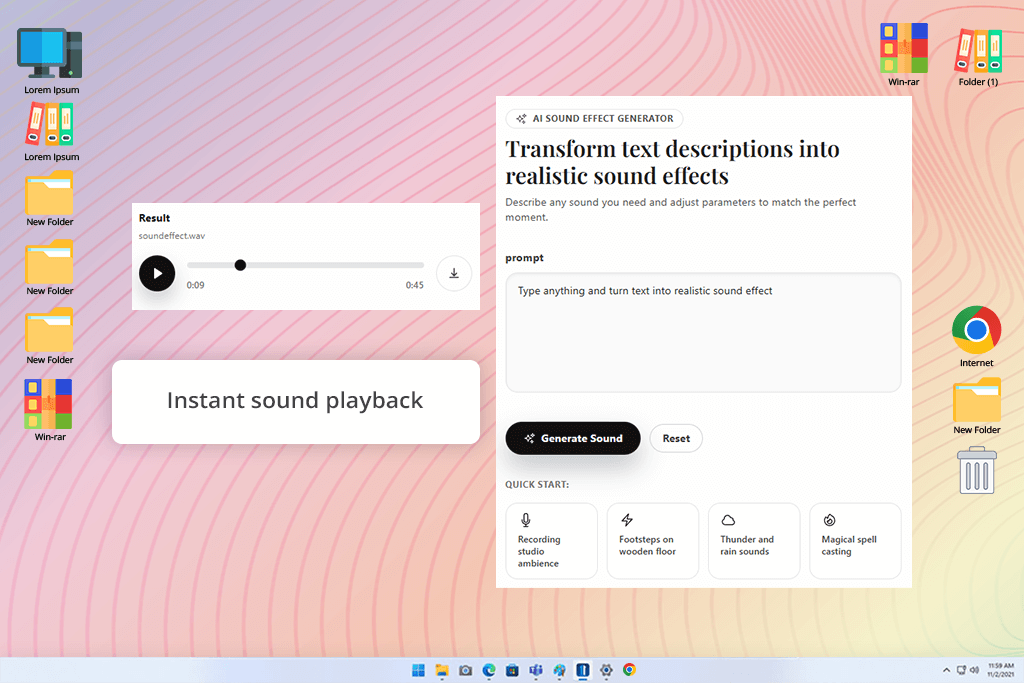

Denna AI-ljudgenerator imponerade mer på mig än jag förväntade mig. Gränssnittet är enkelt och fokuserar bara på att omvandla text till ljud. Jag skrev en enkel beskrivning, "regn på ett metalltak med mjuk åska i fjärran", och det skapade ett trovärdigt, användbart ljudklipp på bara några sekunder.

Det jag gillade mest var hur lätt det var att använda – ingen installation, inga komplicerade kontroller. Det körs direkt i webbläsaren, så vem som helst kan börja direkt. Ljudet det producerade lät klart och naturligt, med bra djup och tonbalans.

Den är definitivt inte designad för fullskalig ljuddesign eller komplex mixning – den är mer för kreatörer som behöver snabbt, färdigt ljud. Jag använde den till slut för snabba redigeringar, korta videor på sociala medier och tillfälliga ljudplatshållare i större projekt.

Det är i princip det enklaste sättet att börja använda AI för ljud. Perfekt för nybörjare eller alla som vill ha snabba resultat snarare än djupgående kontroll. Och om du använder det tillsammans med en DAW för nybörjare, kan det bli en förvånansvärt stark uppsättning.

På FixThePhoto testade vi de mest populära AI-ljudeffektskaparna för att se vilka som faktiskt fungerar lika bra som de annonseras. Idén var enkel – att ta reda på om dessa verktyg realistiskt sett kunde minska tiden som läggs på manuell ljuddesign och redigering genom att använda AI för att skapa ljud mer effektivt.

Testprocessen var en blandning av teknisk kontroll och kreativt omdöme Varje medlem i vårt team (Nataly Omelchenko, Tata Rossi och Kate Debela) testade verktygen ur sitt eget professionella perspektiv.

Nataly, som specialiserar sig på videoredigering och visuell storytelling, fokuserade på hur väl det AI-genererade ljudet stämde överens med det faktiska filmmaterialet. Hon laddade upp olika klipp som resesekvenser, livsstilsbilder och känslosamma minifilmer och bedömde om ljuden matchade tempot, stämningen och handlingen som hände på skärmen.

Tata fokuserade på hur verkliga och välbalanserade ljuden kändes. Hon lyssnade på hur de olika lagren fungerade tillsammans, om volymen och tonen lät naturlig och om ljudet passade in i videon utan mycket extra fixering. Hon noterade också vilka verktyg som var bättre för att skapa en allmän bakgrundsatmosfär och vilka som var mer användbara för skarpa, detaljerade ljudeffekter.

Kate, å andra sidan, koncentrerade sig på hur enkla verktygen var att använda. Hon kontrollerade hur snabbt varje AI-ljudverktyg producerade ljud, om kontrollerna var enkla att förstå och hur smidigt ljuden kunde läggas till i videoredigeringsprogram. Hon tittade också på hur bra verktygen fungerade för nybörjare som inte har erfarenhet av ljuddesign.

Vi samarbetade för att testa varje AI-ljudgenerator i verkliga, vardagliga redigeringssituationer. Vi använde samma videoklipp (från tysta gatuscener till snabba, actionfyllda bilder) och jämförde hur varje verktyg reagerade på samma beskrivning eller stämning. Vissa generatorer imponerade på oss med rikt, lager-på-lager, filmiskt ljud, medan andra utmärkte sig främst för snabbhet och användarvänlighet.

Under testningen utvärderade vi inte bara hur bra det slutliga ljudet lät. Vi tittade också på hur enkelt varje verktyg kunde passa in i en skapares normala arbetsflöde. Skillnaderna var mycket tydliga: Firefly smälte smidigt in i andra Adobe-program, ElevenLabs producerade röster som lät otroligt verklighetstrogna, SFX Engine möjliggjorde mycket exakt ljudkontroll, medan Canva fokuserade på snabb, enkel ljudskapande med minimal ansträngning.

När vi var klara med testerna var det uppenbart att det inte finns ett perfekt AI-verktyg för varje situation – vart och ett fungerar bäst för olika behov. Det som verkligen stack ut var hur avancerat AI-ljud har blivit. Resultaten var ofta förvånansvärt naturliga och kreativa, och det gjorde oss exalterade över att se hur dessa verktyg kommer att fortsätta förbättras i framtiden.