Pracuję jako niezależny montażysta wideo, więc zazwyczaj korzystam z zaawansowanego oprogramowania do ulepszania i skalowania filmów na potrzeby projektów klientów. Programy te mogą dawać świetne rezultaty, ale wymagają również solidnych umiejętności technicznych, wydajnych komputerów i mnóstwa czasu na naukę. Over lata zbudowałem wydajny proces pracy z tymi narzędziami do skalowania wideo. Rozumiem jednak, że taka konfiguracja nie jest realistyczna dla większości osób.

Ostatnio wielu naszych czytelników kontaktowało się z nami, pytając, jak mogą uzyskać podobne rezultaty bez kupowania drogiego oprogramowania lub uczenia się skomplikowanych technik edycji dla jednej edycji. Stało się oczywiste, że użytkownicy szukali łatwiejszego rozwiązania, które pozwoliłoby im poprawić stare lub niskiej jakości filmy przy minimalnym wysiłku. To właśnie skłoniło mnie do zapoznania się z najlepszymi programami do upscaleru wideo opartymi na sztucznej inteligencji, które zostały zaprojektowane, aby zautomatyzować ten proces i uczynić ulepszanie wideo dostępnym dla każdego.

Aby stworzyć tę listę, współpracowałem z kilkoma członkami zespół FixThePhoto. Wspólnie testowaliśmy różnorodne narzędzia AI w różnych sytuacjach (w tym na starych nagraniach rodzinnych i nowoczesnych klipach HD, które wymagały dodatkowego dopracowania). Odkryliśmy, że najmocniejsze skalery wideo oparte na AI oferują znacznie więcej niż tylko zwiększenie rozdzielczości: potrafią doszukiwać over brakujących szczegółów, redukować szumy, naprawiać problemy z ruchem oraz poprawiać ostrość i kolory, oszczędzając jednocześnie wiele godzin pracy ręcznej.

Chociaż upscalery wideo oparte na sztucznej inteligencji to potężne narzędzia, nie są one idealnym rozwiązaniem. Nieprawidłowo użyte mogą dawać nienaturalne rezultaty. Podczas naszych testów over ostatnich kilku miesięcy zauważyłem kilka błędów, które użytkownicy często popełniają podczas ulepszania filmów za pomocą sztucznej inteligencji. Dobra wiadomość jest taka, że tych problemów można łatwo uniknąć, gdy zrozumie się, jak działa ta technologia.

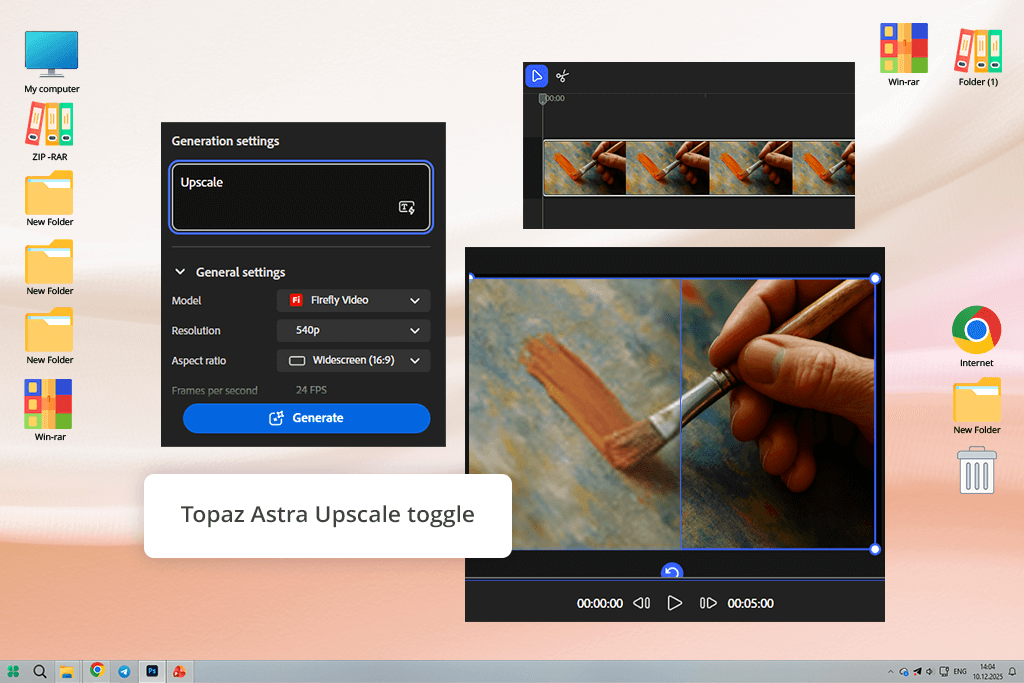

Od dawna ufam produktom Adobe, więc kiedy dowiedziałem się, że Adobe Firefly oferuje funkcję skalowania wideo z wykorzystaniem sztucznej inteligencji (AI) za pomocą Topaz Astra , postanowiłem sam to wypróbować. Połączenie płynnego procesu kreatywnego ze znaną technologią skalowania wideo z wykorzystaniem sztucznej inteligencji (AI) Topaz wydawało się logicznym krokiem dla Adobe. Aby to przetestować, użyłem dwóch starych filmów promocyjnych: jednego nagranego w rozdzielczości 720p i drugiego w zaszumionej jakości 480p, która na nowoczesnych ekranach wyglądała przestarzale.

Otworzyłem Firefly Boards, przesłałem oba filmy i postępowałem zgodnie z nowym procesem. Po wybraniu klipu kliknąłem małą ico Topaz Astra na pasku narzędzi do edycji – łatwo ją przeoczyć, jeśli nie wiesz, że istnieje. W pierwszym filmie wybrałem tryb Precise i ustawiłem rozdzielczość wyjściową na 4K. W drugim klipie wybrałem tryb Creative, aby sprawdzić, ile stylu doda sztuczna inteligencja. Podczas gdy Model wideo Firefly pracował nad filmami w tle, mogłem swobodnie dostosowywać kolory w innych plikach bez żadnych zakłóceń.

Efekt końcowy był imponujący. Klip 720p wyglądał ostro i wyraźnie, gotowy do przesłania na YouTube bez dodatkowej pracy. Film 480p nie wyglądał nagle jak prawdziwe 4K, ale poprawił się na tyle, że można go było wykorzystać w filmie promującym markę klienta, co stanowiło duży krok naprzód w porównaniu z oryginałem. Podobało mi się również to, jak Astra naturalnie radziła sobie z twarzami i ruchem, nie tworząc sztucznego, płynnego efektu, jaki generują niektóre sztuczne skalery wideo. Największą wadą było dla mnie to, że przetwarzanie filmów w wyższej rozdzielczości trwało dłużej, niż się spodziewałem.

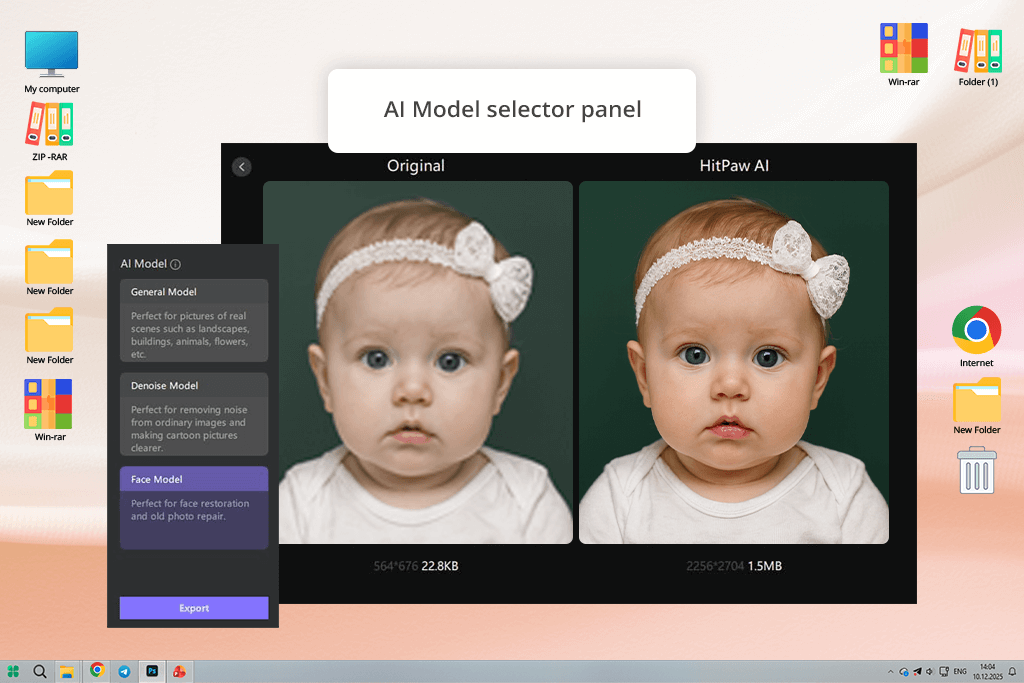

Prawdopodobnie nie przetestowałbym HitPaw gdyby moja koleżanka z pracy, Nataly, nie mention o nim podczas luźnej rozmowy. Opisała go jako proste narzędzie, z którego może korzystać każdy, nawet bez doświadczenia w montażu, więc postanowiłem go wypróbować jako przykład łatwej w obsłudze opcji. Pobrałem wersję na komputery stacjonarne, ponieważ internetowa wersja AI Video Upscaler ogranicza przesyłanie plików, i przetestowałem go na dwóch różnych filmach: wywiadzie z ekspertem i krótkim, animate filmie wyjaśniającym.

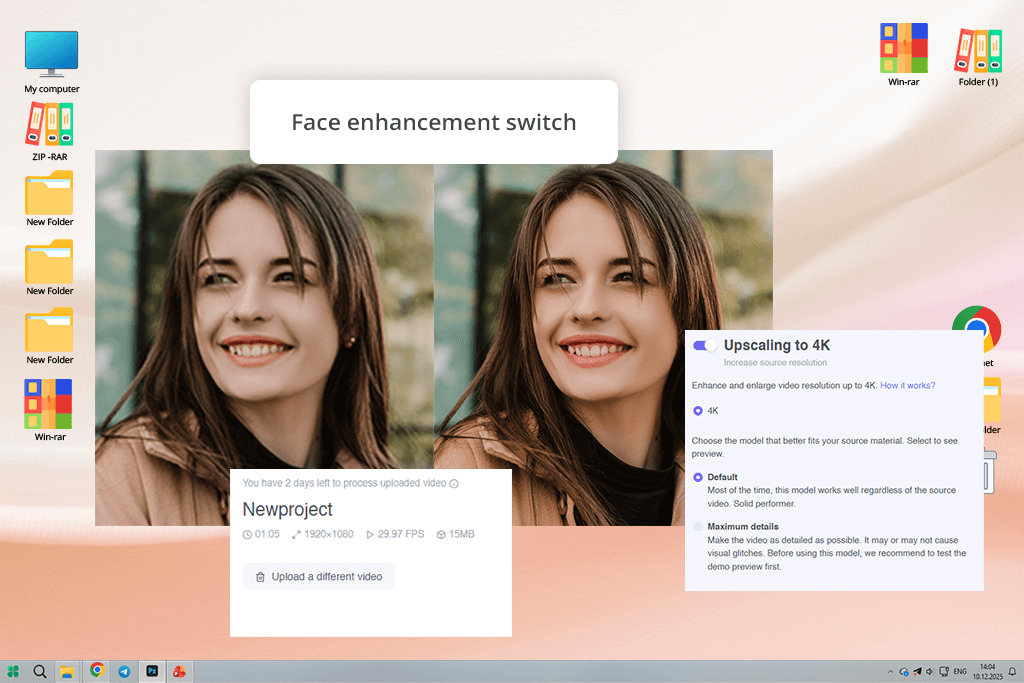

Pierwszą rzeczą, na którą zwróciłem uwagę, był prosty układ: przesyłasz wideo, wybierasz model sztucznej inteligencji (Ogólny, Twarz, Animacja lub UHD), a następnie klikasz „Ulepsz”. W klipie z wywiadem użyłem modelu Twarz. Szybko poprawił on jasność i sprawił, że detale twarzy stały się wyraźniejsze bez żadnych ręcznych zmian. Jednak po bliższym przyjrzeniu się wideo zauważyłem drobne artefakty wizualne na krawędziach podczas szybkich ruchów głowy. Po przełączeniu na model Ogólny wideo wyglądało płynniej i bardziej cons .

Następnie przetestowałem model animacji na filmie objaśniającym i działał dobrze. Kolory były jaśniejsze, linie ostrzejsze, a skalowanie do 4K wyglądało profesjonalnie, zwłaszcza jak na narzędzie, które nie wymaga ręcznych regulacji. Mimo to, prędkość przetwarzania wydawała się niska, a bezpłatny okres próbny był bardzo ograniczony, co utrudniało pełne przetestowanie oprogramowania. Po wykupieniu subskrypcji wydajność wyraźnie się poprawiła, dzięki szybszemu przetwarzaniu, lepszej jakości eksportu i ogólnie płynniejszym wynikom AI.

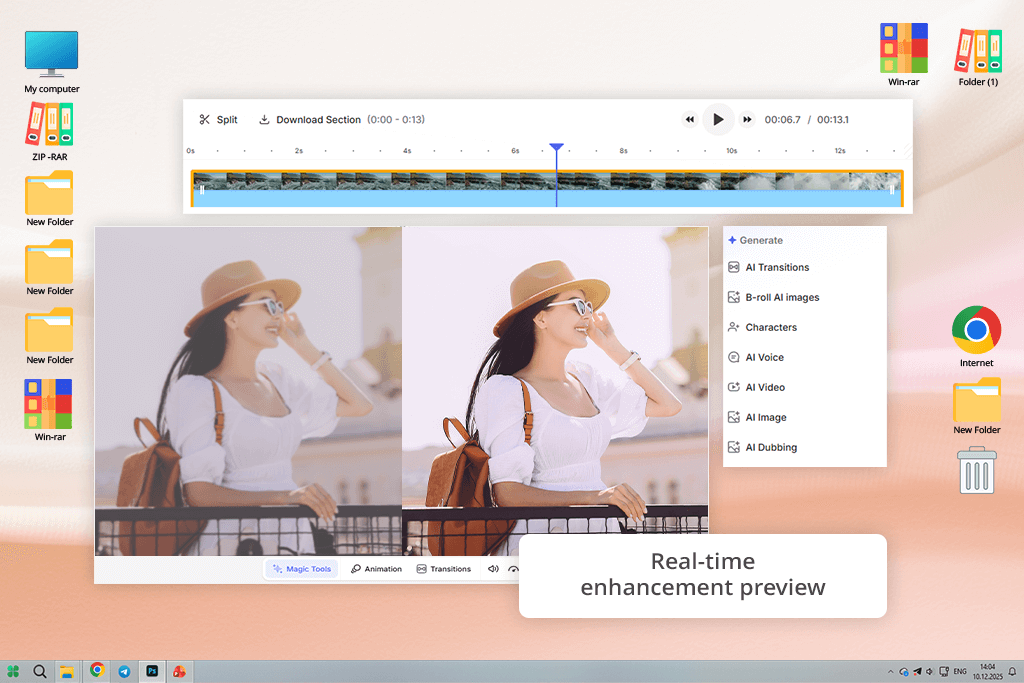

VEED to jedno z moich ulubionych narzędzi, gdy potrzebuję edytować lub udoskonalić krótkie filmy do mediów społecznościowych. Ponieważ często tworzę treści na Instagram i YouTube Shorts, podoba mi się fakt, że wszystko działa bezpośrednio w przeglądarce. Nie trzeba niczego instalować, nie potrzeba mocnego komputera ani stresu technicznego. Mogę usiąść w kawiarni z laptopem, wgrać film i od razu zacząć montować.

Kiedy wypróbowałem AI Enhancer w VEED , spodobało mi się, jak płynnie wpasowuje się w cały proces edycji. Przesłałem kilka filmów zza kulis z shoot zdjęciowej i użyłem funkcji AI upscaling wraz z redukcją szumów i korekcją kolorów. Jedną z najlepszych funkcji jest podgląd na żywo: możesz zobaczyć, jak wideo staje się wyraźniejsze i jaśniejsze wraz ze zmianą ustawień. Doceniam również to, że napisy, przycinanie i podstawowe edycje są dostępne w tym samym obszarze roboczym.

Mimo to VEED ma pewne ograniczenia. Sprawdza się dobrze dla marketerów i twórców treści, którzy potrzebują szybkości, ale darmowa wersja ogranicza jakość eksportu, a wszystko zależy od dobrego połączenia internetowego. Praca offline jest całkowicie niemożliwa. Mimo to VEED sprawdza się doskonale w pracy zespołowej i szybkich edycjach. Często wysyłam wersje podglądowe moim współpracownikom za pośrednictwem współdzielonej przestrzeni roboczej i jest to jeden z najłatwiejszych systemów współpracy, z jakich korzystałem w edytorze online.

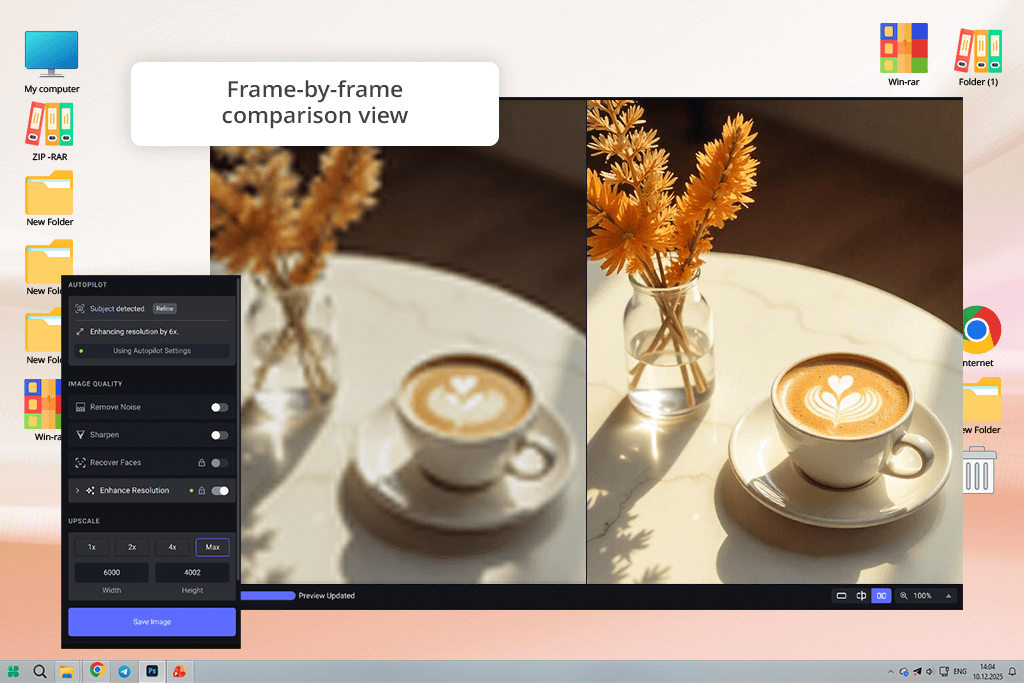

Ponieważ Adobe Firefly korzysta z technologii Topaz , chciałem sprawdzić, jak Topaz działa samodzielnie. Firefly oferuje przejrzyste i intuicyjne środowisko, ale byłem ciekaw możliwości korzystania z Topaz Video AI bez żadnych ograniczeń. Zainstalowałem go na moim głównym komputerze i przetestowałem na różnych materiałach, w tym na poruszonych ujęciach z ręki, ciemnych scenach we wnętrzach i starych filmach z przeplotem z lustrzanki cyfrowej.

Na pierwszy rzut oka rzucał się w oczy poziom kontroli, jaki oferuje Topaz . Zamiast pojedynczego przycisku „ulepsz”, wybierasz konkretne modele sztucznej inteligencji, takie jak Artemis, Proteus czy Iris, regulujesz suwaki i porównujesz wyniki klatka po klatce. W przypadku jednego klipu przy słabym oświetleniu przetestowałem dwa modele, jeden po drugim, aby sprawdzić, jak radzą sobie z szumem i ruchem. Podgląd obok siebie ułatwił dostrzeżenie różnic: jeden zachowywał więcej szczegółów, a drugi zapewniał płynniejszy ruch.

Jednak to Oprogramowanie Topaz wymaga mocnego sprzętu. Renderowanie filmów zużywa dużo mocy systemu, a moja karta graficzna była mocno obciążona podczas dużych eksportów. Niemniej jednak rezultaty były warte wysiłku. Finalne filmy wyglądały kinowo, a nie sztucznie. Krawędzie pozostały wyraźne, ruch stabilny, a kolory naturalne. Ten AI upscaler wideo nie jest idealny do szybkich edycji w mediach społecznościowych, ale dla twórców, którym zależy na szczegółowej jakości klatka po klatce, Topaz jest trudny do pobicia.

Można się nie spodziewać, że Adobe Premiere Pro pojawi się tutaj, ponieważ jest znany jako profesjonalny program do edycji, a nie proste narzędzie oparte na sztucznej inteligencji. Jednak Adobe over czasem dodaje więcej funkcji sztucznej inteligencji, a opcja skalowania w Premiere Pro jest tego dobrym przykładem. Od lat używam Premiere do gradacji kolorów i edycji nagrań z wielu kamer, a ostatnio postanowiłem dokładnie przetestować jego efekt skalowania z zachowaniem szczegółów.

Zaimportowałem stary film demonstracyjny produktu w rozdzielczości 720p. W panelu Efekty wyszukałem „Detail-Preserving Upscale”, zastosowałem go i zwiększyłem skalę do 200%, aby uzyskać jakość zbliżoną do 4K. Najbardziej zaimponował mi poziom kontroli. Zamiast pozwolić sztucznej inteligencji zająć się wszystkim, mogłem samodzielnie dostosować redukcję szumów i szczegóły tekstur. Ustawienie redukcji szumów działało dobrze, usuwając pikselozę, a jednocześnie zachowując ostrość tekstu i twarzy.

Premiere Pro nie jest tani i nauka jego obsługi wymaga czasu. Jeśli jednak korzystasz z niego w ramach subskrypcji Adobe, nie musisz szukać kolejnego narzędzia do skalowania wideo. Jest niezawodny, elastyczny i zapewnia pełną kontrolę over każdą klatką, czyli dokładnie tego, czego można oczekiwać od profesjonalnego oprogramowania z wbudowanymi funkcjami sztucznej inteligencji.

Prawdopodobnie sam nie znalazłbym Neural Love . Moja koleżanka z pracy, Tati, zauważyła reklamę i zasugerowała, żebyśmy wypróbowali. Postanowiliśmy przeprowadzić szybki, ale przydatny test, używając krótkich filmów nagranych telefonem i klipów w stylu mediów społecznościowych, ponieważ to właśnie o te pliki najczęściej pytają nasi czytelnicy. Celem było sprawdzenie, czy w pełni oparte na przeglądarce narzędzie do skalowania wideo oparte na sztucznej inteligencji (AI) może generować akceptowalne rezultaty bez konieczności stosowania specjalistycznego sprzętu.

Korzystanie z Neural Love było bardzo proste. Przesłałem pionowy film bezpośrednio ze strony internetowej, wybrałem opcje korekcji i pozwoliłem, aby sztuczna inteligencja w chmurze zajęła się wszystkim. Nie było żadnych skomplikowanych ustawień ani suwaków do regulacji. Narzędzie automatycznie poprawiło ostrość, oświetlenie i wyrazistość twarzy. Po zakończeniu przetwarzania film wyglądał jaśniej i wyraźniej. Twarze były lepiej widoczne, a ciemne obszary wydawały się bardziej zrównoważone.

Jednak ta sama prostota może być również wadą. Nie było możliwości kontrolowania siły efektu sztucznej inteligencji, a pracując z bardziej złożonymi materiałami, brakowało mi bardziej zaawansowanych opcji. Darmowa wersja ogranicza również rozmiar pliku, dzięki czemu narzędzie nadaje się raczej do krótkich lub średniej długości filmów niż do dużych projektów. Mimo to, dla twórców, którzy szukają szybkiego rozwiązania działającego całkowicie online, Neural Love spełnia swoje obietnice.

Przetestowałem Gigapixel z konkretnym celem. Czasami pracujemy z filmami, w których płynność ruchu jest ważniejsza niż ekstremalna ostrość, więc zamiast luźnych klipów użyłem krótkiego, kinowego filmu z ruchem kamery i drobnymi detalami – dokładnie takiego materiału, w którym narzędzia AI często borykają się z migotaniem lub niestabilnymi teksturami.

Gigapixel wyraźnie traktuje wideo jako ciągłą sekwencję, a nie oddzielne obrazy. Przeszedłem przez oś czasu klatka po klatce, a detale pozostały stabilne, bez migających tekstur i dziwnych zniekształceń krawędzi. Nawet w scenach z dużą ilością ruchu, skalowanie wideo przez sztuczną inteligencję wydawało się kontrolowane i cura . Byłem również pod wrażeniem tego, jak dobrze radził sobie ze skompresowanymi filmami, redukując blokowate artefakty, zachowując jednocześnie ważne szczegóły.

Jednak Gigapixel sprawia wrażenie oprogramowania stworzonego dla profesjonalistów zajmujących się postprodukcją, a nie do szybkiego i codziennego użytku. Czas przetwarzania wydłużał się, gdy pracowałem z wyższą liczbą klatek na sekundę, a interfejs zakłada, że użytkownik zna już takie kwestie, jak rozdzielczość, formaty wideo i ustawienia eksportu, takie jak ProRes.

Aby nasze testy były uczciwe i praktyczne, skupiliśmy się na funkcjach, które mają znaczenie w rzeczywistym skalowaniu wideo, a nie na obietnicach marketingowych. Zacząłem od testowanie jak dobrze każde narzędzie radzi sobie ze skalowaniem rozdzielczości, zwłaszcza w przypadku popularnych zmian, takich jak 720p do 1080p i 1080p do 4K. Dokładnie sprawdziłem, czy sztuczna inteligencja zachowuje drobne detale, takie jak twarze, tekst i krawędzie, czy też tworzy sztuczne tekstury, które na pierwszy rzut oka wydają się ostre, ale po bliższym przyjrzeniu się rozpadają.

Stabilność ruchu była kolejnym ważnym elementem. Nataly przeglądała klipy z ruchami kamery, gestami rąk i szybkimi zmianami scen, sprawdzając cons między klatkami. Migotanie, niestabilne krawędzie i pulsujące tekstury są powszechne w upscalingu AI, więc ostrożnie poruszała się po materiale klatka po klatce, aby wychwycić problemy, które mogłyby nie być oczywiste podczas normalnego odtwarzania.

Tati skupiła się na tym, jak każde narzędzie radzi sobie z szumem i defektami wizualnymi. Testowała filmy przy słabym oświetleniu, skompresowane klipy i starsze nagrania, aby sprawdzić, czy sztuczna inteligencja może zredukować szum bez rozmycia szczegółów lub pogorszenia artefaktów kompresji. W kilku sytuacjach porównywała różne poziomy mocy, aby znaleźć punkt, w którym poprawa się zatrzymała, a wideo zaczęło wyglądać na przeciążone.

Zachowanie kolorów również miało znaczenie. Zwróciłem uwagę na zmiany jasności, kontrastu i nasycenia oraz sprawdziłem, czy odcienie skóry nadal wyglądają naturalnie po zwiększeniu skali.

Na koniec sprawdziliśmy wydajność każdego z systemów skalowania wideo opartych na sztucznej inteligencji, w tym szybkość przetwarzania, cura podglądu, niezawodność eksportu oraz to, jak dobrze oprogramowanie wpisywało się w rzeczywiste procesy edycji, a nie w odosobnione sytuacje testowe. Ta metoda pozwoliła nam oprzeć wnioski na codziennej wydajności, a nie na jednorazowych testach.