Jag arbetar som frilansande videoredigerare, så jag förlitar mig vanligtvis på avancerad programvara för att förbättra och skala upp videor för kundprojekt. Dessa program kan ge fantastiska resultat, men de kräver också starka tekniska färdigheter, kraftfulla datorer och mycket tid att lära sig. Over årens lopp har jag byggt upp ett effektivt arbetsflöde med dessa verktyg för videouppskalning. Jag förstår dock att den här typen av uppställning inte är realistisk för de flesta.

På senare tid har många av våra läsare kontaktat oss för att fråga hur de kan få liknande resultat utan att köpa dyr programvara eller lära sig komplicerade redigeringstekniker för en enda redigering. Det blev uppenbart att folk ville ha ett enklare alternativ som kunde förbättra gamla eller lågkvalitativa videor med minimal ansträngning. Det var det som fick mig att utforska de bästa AI-videouppskalarna, som är utformade för att automatisera processen och göra videoförbättring tillgänglig för alla.

För att sammanställa den här listan arbetade jag med flera lagkamrater från FixThePhoto teamet. Tillsammans testade vi en mängd olika AI-verktyg i olika situationer (inklusive gamla familjeinspelningar och moderna HD-klipp som behövde extra förfining). Vi fann att de starkaste AI-videouppskalarna gör mycket mer än att öka upplösningen: de kan spela over saknade detaljer, minska brus, åtgärda rörelseproblem och förbättra skärpa och färg, samtidigt som de sparar många timmars manuellt arbete.

Även om AI-videouppskalare är kraftfulla verktyg är de inte perfekta lösningar. Om de används felaktigt kan de ge resultat som ser onaturliga ut. Under våra tester over de senaste månaderna har jag lagt märke till flera misstag som användare ofta gör när de förbättrar videor med AI. Den goda nyheten är att dessa problem är lätta att undvika när man väl förstår hur tekniken fungerar.

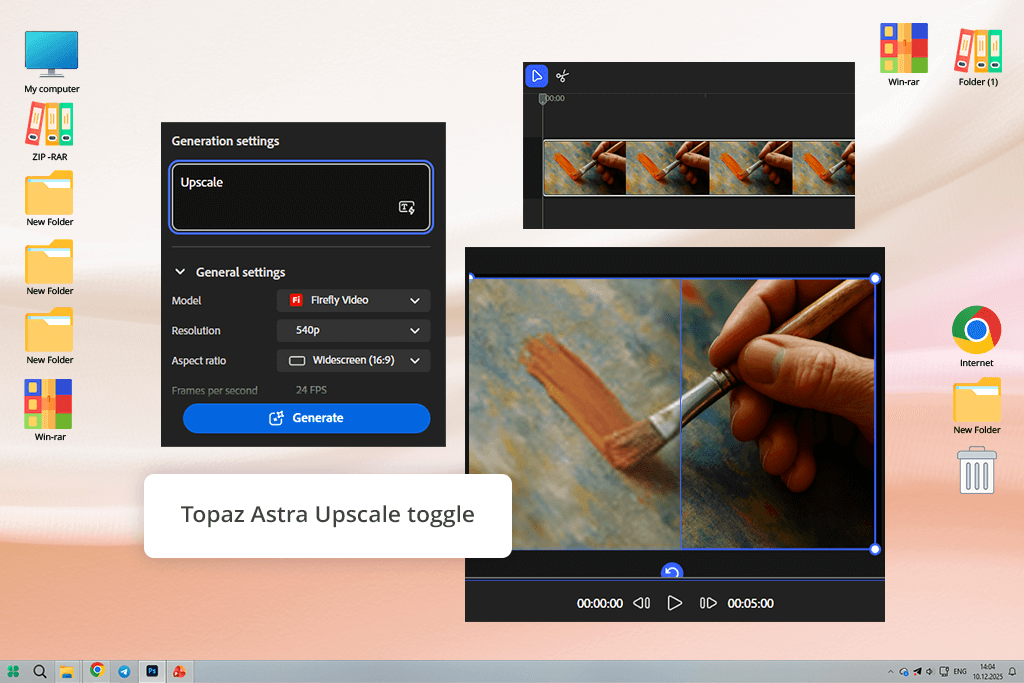

Jag har litat på Adobes produkter länge, så när jag fick reda på att Adobe Firefly hade lagt till AI-videouppskalning med Topaz Astra ville jag prova det själv. Att blanda det smidiga kreativa arbetsflödet med Topaz välkända AI-uppskalningsteknik verkade vara ett logiskt steg för Adobe. För att testa det använde jag två gamla reklamvideor: en inspelad i 720p och en annan i en bullrig 480p-kvalitet som såg föråldrad ut på moderna skärmar.

Jag öppnade Firefly Boards, laddade upp båda videorna och följde den nya processen. Efter att ha valt ett klipp klickade jag på den lilla Topaz Astra ico i redigeringsverktygsfältet – den är lätt att missa om man inte redan vet att den finns. För den första videon valde jag Precisionsläge och ställde in utdata på 4K. För det andra klippet valde jag Kreativt läge för att se hur mycket stil AI:n skulle lägga till. Medan Firefly videomodell arbetade på videorna i bakgrunden, kunde jag justera färgerna på andra filer utan avbrott.

Slutresultaten var imponerande. 720p-klippet såg skarpt och tydligt ut, redo att laddas upp till YouTube utan extra arbete. 480p-videon såg inte plötsligt ut som äkta 4K, men den förbättrades tillräckligt för att användas i en kunds varumärkesvideo, vilket var ett stort steg upp från originalet. Jag gillade också hur Astra naturligt hanterade ansikten och rörelser, utan att skapa det falska, släta utseendet som vissa AI-videouppskalare producerar. Den största nackdelen för mig var att videor med högre upplösning tog längre tid att bearbeta än jag förväntade mig.

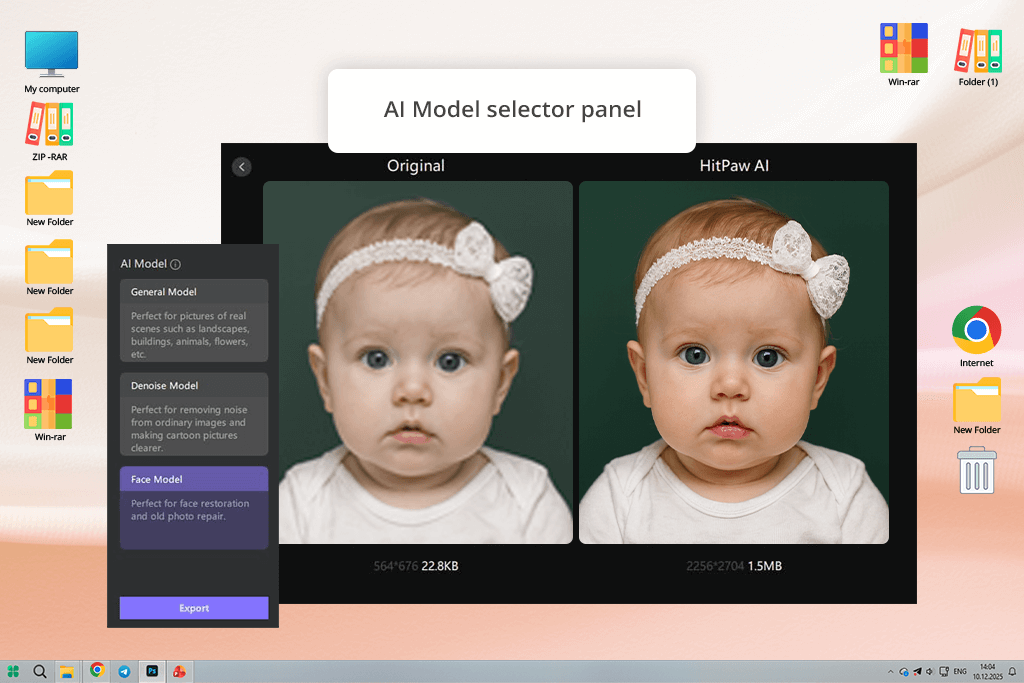

Jag hade förmodligen inte testat HitPaw om inte min kollega Nataly hade mention det under ett samtal. Hon beskrev det som ett enkelt verktyg som vem som helst kan använda, även utan redigeringserfarenhet, så jag bestämde mig för att testa det som ett exempel på ett lättanvänt alternativ. Jag laddade ner skrivbordsversionen eftersom AI-videouppskalningsprogrammets onlineversion begränsar filuppladdningar, och jag testade det på två olika videor: en intervju med en talande huvudperson och en kort, animate förklaring.

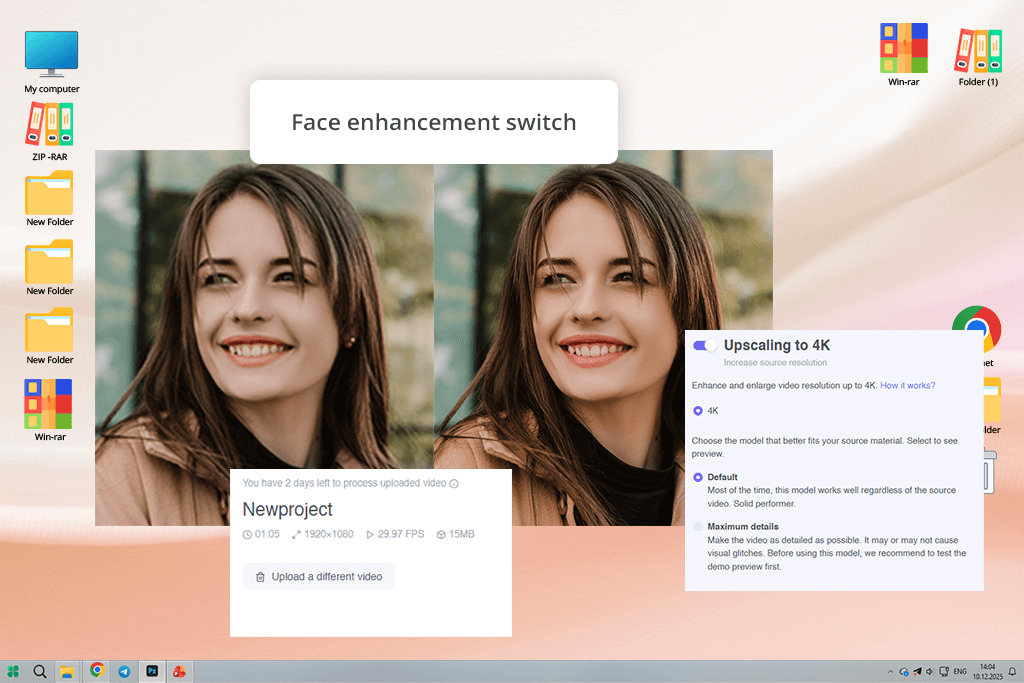

Det första jag lade märke till var hur enkel layouten är: du laddar upp din video, väljer en AI-modell (Generell, Ansikte, Animering eller UHD) och klickar sedan på "Förbättra". Jag använde ansiktsmodellen i intervjuklippet. Den förbättrade snabbt ljusstyrkan och gjorde ansiktsdetaljer tydligare utan några manuella ändringar. Men när jag granskade videon noggrant lade jag märke till små visuella artefakter runt kanterna under snabba huvudrörelser. När jag bytte till den allmänna modellen såg videon jämnare och mer konsekvent ut.

Därefter testade jag animationsmodellen på förklarande video, och den presterade bra. Färgerna såg ljusare ut, linjerna var skarpare och 4K-uppskalningen såg professionell ut, särskilt för ett verktyg som inte kräver några manuella justeringar. Med det sagt kändes bearbetningshastigheten långsam, och den kostnadsfria provperioden var mycket begränsad, vilket gjorde det svårt att testa programvaran fullt ut. Efter att ha köpt prenumerationen förbättrades dock prestandan märkbart, med snabbare bearbetning, exporter av bättre kvalitet och smidigare AI-resultat överlag.

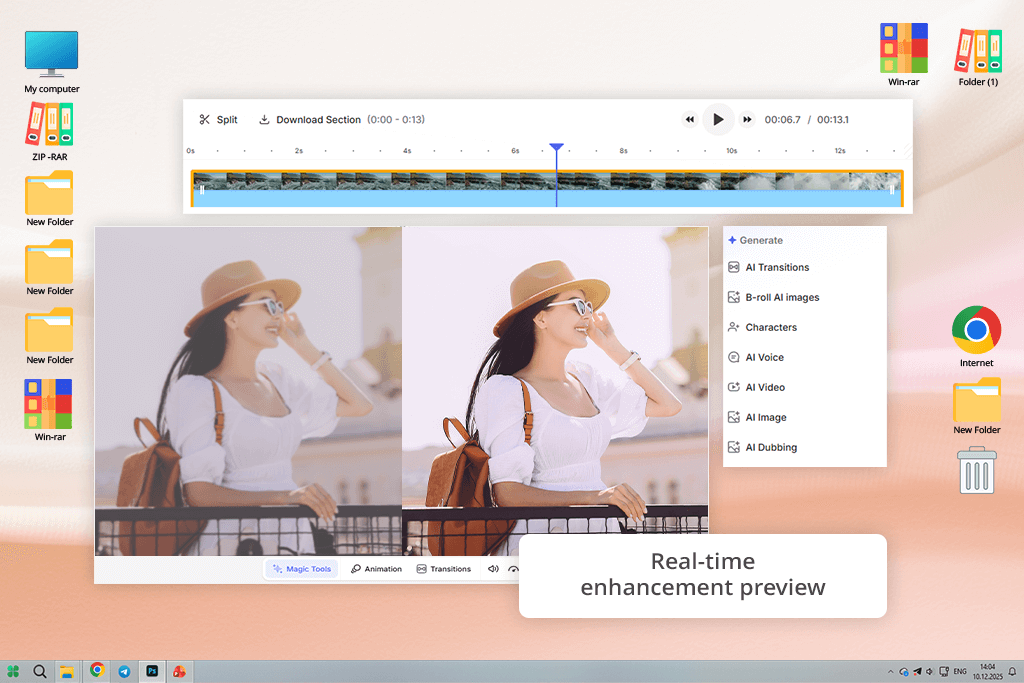

VEED är ett av mina verktyg när jag behöver redigera eller skala upp korta videor för sociala medier. Eftersom jag ofta skapar innehåll för Instagram och YouTube Shorts uppskattar jag att allt fungerar direkt i webbläsaren. Det finns inget behov av att installera någonting, inget behov av en kraftfull dator och ingen teknisk stress. Jag kan sitta på ett kafé med min laptop, ladda upp en video och börja redigera direkt.

När jag testade VEED AI Enhancer gillade jag hur smidigt det passade in i den övergripande redigeringsprocessen. Jag laddade upp flera bakom-kulisserna-videor från en shoot och använde AI-uppskalning tillsammans med brusreducering och färgkorrigering. En av de bästa funktionerna är live-förhandsvisningen: du kan se videon bli tydligare och ljusare när du justerar inställningarna. Jag uppskattar också att undertexter, beskärning och grundläggande redigeringar är tillgängliga i samma arbetsyta.

Med det sagt har VEED vissa begränsningar. Det fungerar bra för marknadsförare och innehållsskapare som behöver hastighet, men gratisversionen begränsar exportkvaliteten, och allt beror på att man har en bra internetanslutning. Man kan inte arbeta offline alls. Trots det är VEED starkt när det gäller lagarbete och snabba redigeringar. Jag skickar ofta förhandsvisningsversioner till mina lagkamrater med hjälp av den delade arbetsytan, och det är ett av de enklaste samarbetssystemen jag har använt i en onlineredigerare.

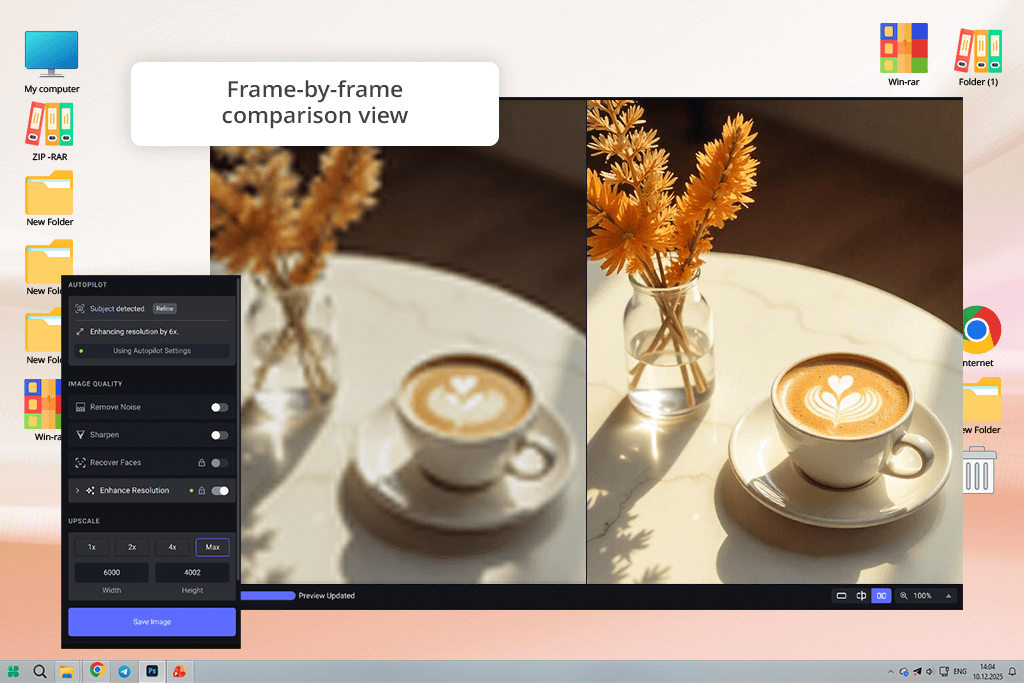

Eftersom Adobe Firefly använder Topaz -teknik ville jag se hur Topaz presterar på egen hand. Firefly erbjuder en ren och guidad upplevelse, men jag var nyfiken på att använda Topaz Video AI utan några begränsningar. Jag installerade det på min huvuddator och testade det på olika typer av filmmaterial, inklusive skakiga handhållna klipp, mörka inomhusscener och gamla sammanflätade videor från en systemkamera.

Det som först stack ut var den kontrollnivå som Topaz erbjuder. Istället för en enda "förbättra"-knapp väljer du specifika AI-modeller som Artemis, Proteus eller Iris, justerar reglagen och jämför resultaten bildruta för bildruta. För ett klipp i svagt ljus testade jag två modeller, en efter en, för att se hur de hanterade brus och rörelse. Förhandsgranskningen sida vid sida gjorde det enkelt att upptäcka skillnader: den ena behöll fler detaljer, medan den andra producerade jämnare rörelse.

Denna Topaz -programvara kräver dock stark hårdvara. Att rendera videor förbrukar mycket systemkraft, och mitt grafikkort ansträngdes hårt under stora exporter. Resultaten var dock värda ansträngningen. De slutliga videorna såg filmiska ut, inte alls artificiella. Kanterna förblev rena, rörelserna såg stabila ut och färgerna förblev naturliga. Denna AI-videouppskalare är inte idealisk för snabba redigeringar på sociala medier, men för kreatörer som bryr sig om detaljerad bildruta-för-bildruta-kvalitet är Topaz svår att slå.

Du kanske inte förväntar dig att Adobe Premiere Pro ska dyka upp här, eftersom det är känt som ett professionellt redigeringsprogram snarare än ett enkelt AI-verktyg. Men Adobe har lagt till fler AI-funktioner over tiden, och uppskalningsalternativet i Premiere Pro är ett starkt exempel. Jag har använt Premiere i flera år för färggradering och redigering med flera kameror, och jag bestämde mig nyligen för att testa dess detaljbevarande uppskalningseffekt ordentligt.

Jag importerade en gammal produktdemovideo i 720p. I effektpanelen sökte jag efter "Detaljbevarande uppgradering", tillämpade det och ökade skalan till 200 % för att nå nära 4K-kvalitet. Det som imponerade mest på mig var mängden kontroll. Istället för att låta AI hantera allt kunde jag justera brusreducering och texturdetaljer själv. Brusreduceringsinställningen fungerade bra och tog bort pixelering samtidigt som text och ansikten hölls skarpa.

Premiere Pro är inte billigt, och det tar tid att lära sig. Men om du redan har det via en Adobe-prenumeration behöver du inte leta efter ett annat verktyg för videouppskalning. Det är pålitligt, flexibelt och ger dig full kontroll over varje bildruta, vilket är precis vad du kan förvänta dig av professionell programvara med inbyggda AI-funktioner.

Jag skulle förmodligen inte ha hittat Neural Love på egen hand. Min kollega Tati lade märke till en annons för det och föreslog att vi skulle testa det. Vi bestämde oss för att göra ett snabbt men användbart test med korta telefonvideor och klipp i sociala medier-stil, eftersom det är den typen av filer våra läsare frågar om oftast. Målet var att se om ett helt webbläsarbaserat AI-videouppskalningsverktyg kunde ge acceptabla resultat utan speciell hårdvara.

Att använda Neural Love var väldigt enkelt. Jag laddade upp en vertikal video direkt via webbplatsen, valde förbättringsalternativen och lät den molnbaserade AI:n hantera allt. Det fanns inga komplicerade inställningar eller reglage att justera. Verktyget förbättrade automatiskt skärpa, ljusstyrka och ansiktstydlighet. När bearbetningen var klar såg videon ljusare och renare ut. Ansikten var lättare att se och mörka områden verkade mer balanserade.

Samma enkelhet kan dock också vara en nackdel. Det fanns inget sätt att kontrollera hur stark AI-effekten var, och när jag arbetade med mer komplexa filmsekvenser önskade jag mig mer avancerade alternativ. Gratisversionen begränsar också filstorleken, vilket gör verktyget lämpligt för korta eller medellånga videor snarare än stora projekt. Ändå, för skapare som vill ha en snabb lösning som fungerar helt online, gör Neural Love vad den lovar.

Jag testade Gigapixel med ett specifikt syfte. Ibland arbetar vi med videor där jämn rörelse är viktigare än extrem skärpa, så istället för enstaka klipp använde jag en kort filmisk video med kamerarörelser och fina detaljer – precis den typen av filmmaterial där AI-verktyg ofta kämpar med flimmer eller instabila texturer.

Gigapixel behandlar video tydligt som en kontinuerlig sekvens, inte som separata bilder. Jag gick igenom tidslinjen bildruta för bildruta, och detaljerna förblev stabila utan blinkande texturer eller konstiga kantförvrängningar. Även i scener med mycket rörelse kändes AI-videouppskalningen kontrollerad och cura . Jag var också imponerad av hur väl den hanterade komprimerade videor, vilket minskade blockartefakter samtidigt som viktiga detaljer behölls intakta.

Gigapixel känns dock som programvara gjord för postproduktionsproffs, inte för snabb eller avslappnad användning. Bearbetningstiderna ökade när jag arbetade med högre bildfrekvenser, och gränssnittet förutsätter att du redan förstår saker som upplösning, videoformat och exportinställningar som ProRes.

För att hålla våra tester rättvisa och praktiska fokuserade vi på funktioner som är viktiga vid uppskalning av video i verkligheten, inte marknadsföringspåståenden. Jag började med att testning hur väl varje verktyg hanterade upplösningsskalning, särskilt vanliga uppgraderingar som 720p till 1080p och 1080p till 4K. Jag undersökte noggrant om AI:n behöll fina detaljer som ansikten, text och kanter, eller om den skapade falska texturer som ser skarpa ut till en början men faller isär vid närmare granskning.

Rörelsestabilitet var ett annat viktigt fokus. Nataly granskade klipp med kamerarörelser, handgester och snabba scenbyten och kontrollerade bildrutekonsekvens. Flimmer, instabila kanter och pulserande texturer är vanliga vid AI-uppskalning, så hon gick försiktigt igenom filmmaterialet bildruta för bildruta för att upptäcka problem som kanske inte är uppenbara under normal uppspelning.

Tati fokuserade på hur varje verktyg hanterade brus och visuella defekter. Hon testade videor i svagt ljus, komprimerade klipp och äldre inspelningar för att se om AI:n kunde minska brus utan att sudda ut detaljer eller förvärra kompressionsartefakter. Under flera omständigheter jämförde hon olika styrkanivåer för att hitta punkten där förbättringen upphörde, och videon började se överbearbetad ut.

Färgbeteendet var också viktigt. Jag var uppmärksam på förändringar i ljusstyrka, kontrast och mättnad, och kontrollerade om hudtonerna fortfarande såg naturliga ut efter uppskalning.

Slutligen granskade vi hur effektiv varje AI-videouppskalare var, inklusive bearbetningshastighet, cura , exporttillförlitlighet och hur väl programvaran passade in i verkliga redigeringsarbetsflöden snarare än isolerade testsituationer. Denna metod hjälpte oss att basera våra slutsatser på daglig prestanda istället för engångstester.